Cuộc trò chuyện xung quanh trí tuệ nhân tạo đang mở rộng nhanh chóng trong thế giới công nghệ. Mỗi tuần, chúng ta thấy các mô hình mới, khả năng mới, và các ứng dụng mới xuất hiện. Nhưng bên cạnh sự tiến bộ nhanh chóng này, một câu hỏi khác vẫn tiếp tục lớn lên: làm thế nào để chúng ta xác minh các đầu ra được sản xuất bởi các hệ thống AI?

Trí tuệ nhân tạo có thể phân tích các bộ dữ liệu khổng lồ, tạo ra những hiểu biết, và tự động hóa các quy trình nhanh hơn bao giờ hết. Tuy nhiên, tốc độ đơn thuần không đảm bảo độ tin cậy. Khi AI được tích hợp vào các hệ thống quan trọng, việc đảm bảo rằng các đầu ra là đáng tin cậy trở nên ngày càng quan trọng.

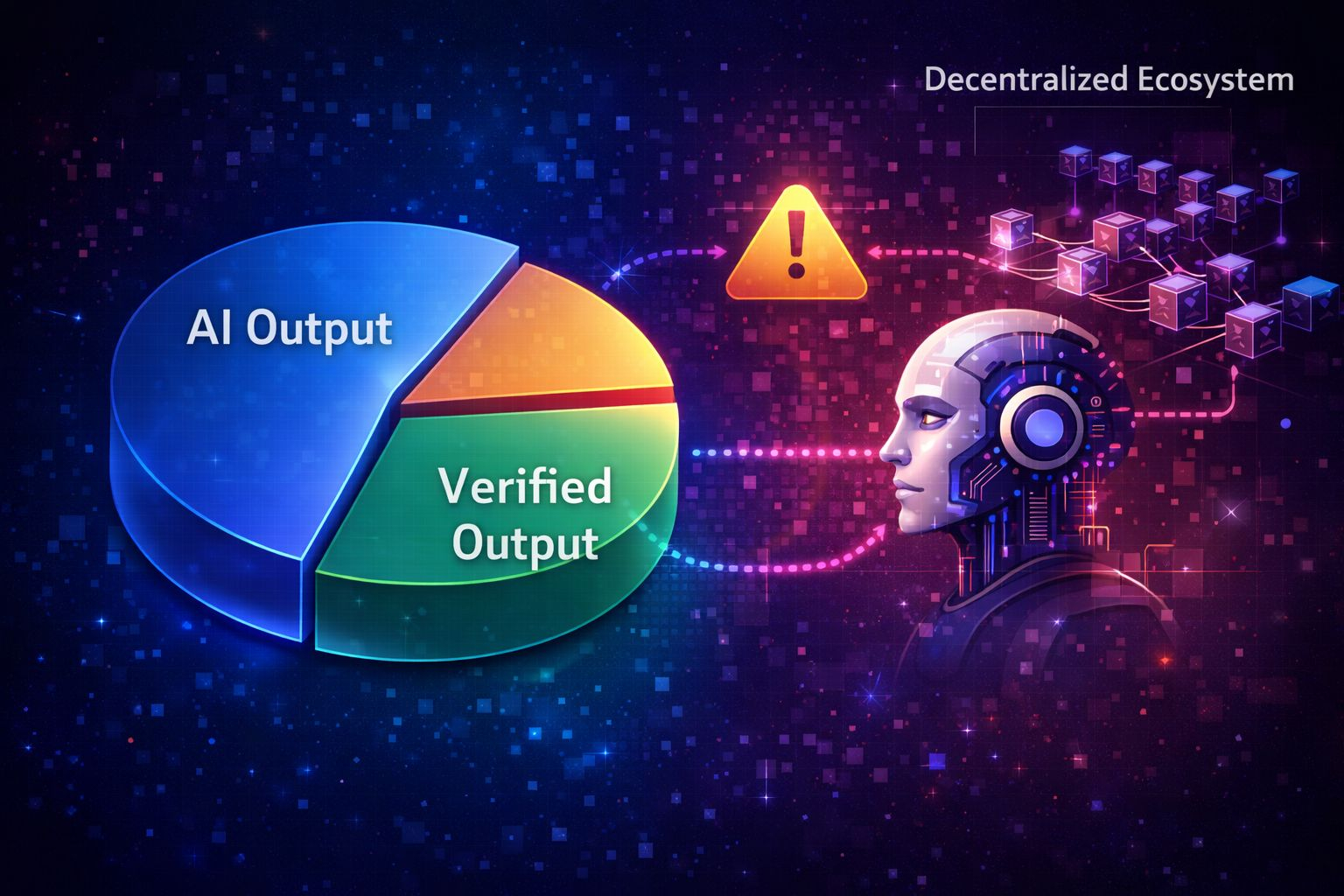

Thách thức này trở nên phức tạp hơn trong các hệ sinh thái phi tập trung. Trong các nền tảng tập trung truyền thống, người dùng thường dựa vào độ tin cậy của các công ty vận hành hệ thống. Nhưng trong các môi trường Web3, lòng tin cần phải đến từ các cơ chế minh bạch hơn là từ quyền lực tập trung.

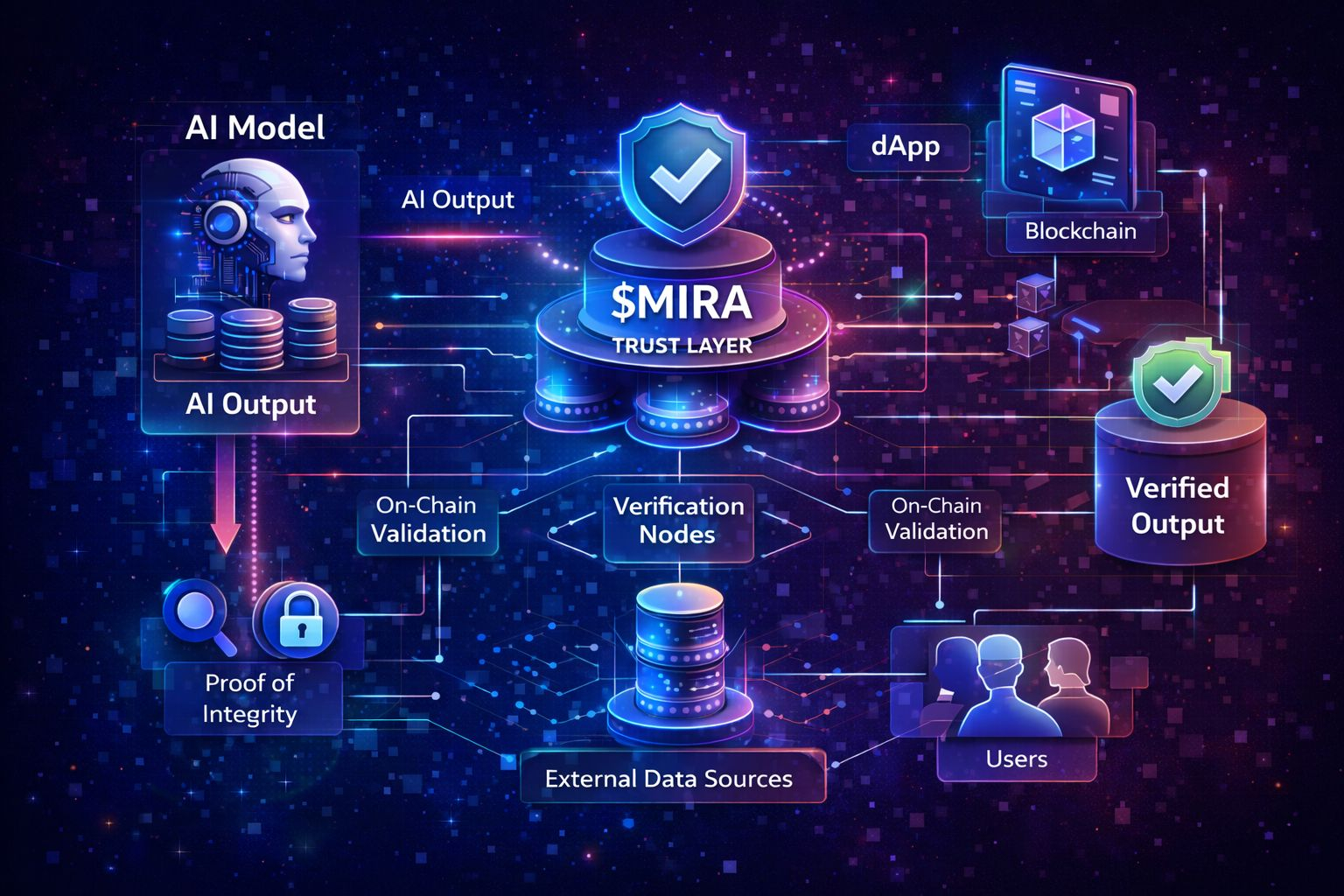

Đây là một lý do tại sao các dự án khám phá cơ sở hạ tầng xác minh đang thu hút sự chú ý. Trong khi nghiên cứu các phương pháp khác nhau, tôi bắt đầu nhìn sâu hơn vào ý tưởng đằng sau @mira_network và cách $MIRA nhằm khám phá khái niệm về một lớp tin cậy cho AI.

Ý tưởng này thú vị vì đầu ra của AI thường rất khó để xác minh nhanh chóng. Một mô hình AI có thể tạo ra một phản hồi trong vài giây, nhưng việc xác minh phản hồi đó có thể cần thời gian, chuyên môn và quyền truy cập vào các nguồn dữ liệu đáng tin cậy. Sự mất cân bằng giữa việc tạo ra và xác minh tạo ra những thách thức tiềm năng khi việc áp dụng AI gia tăng.

Nếu các ứng dụng phi tập trung bắt đầu dựa vào những hiểu biết do AI cung cấp, các hệ thống phải tồn tại để xác nhận rằng những hiểu biết đó đáp ứng các tiêu chuẩn độ tin cậy. Các lớp xác minh có thể giúp cung cấp sự minh bạch và tự tin khi các hệ thống AI tương tác với các ứng dụng dựa trên blockchain.

Một lý do khác mà chủ đề này quan trọng là sự chồng chéo ngày càng tăng giữa AI và Web3. Các mạng blockchain hiện đang được sử dụng cho các hệ thống tài chính, quyền sở hữu kỹ thuật số, cơ chế quản trị và cơ sở hạ tầng phân tán. Khi các công cụ AI tích hợp với những môi trường này, việc đảm bảo đầu ra đáng tin cậy trở thành một yếu tố quan trọng.

Các dự án như @mira_network đang khám phá cách mà cơ sở hạ tầng phi tập trung có thể hỗ trợ quy trình xác minh AI. Khái niệm đằng sau $MIRA tập trung vào việc xây dựng các khung cho phép kết quả AI được xác thực thay vì được chấp nhận mù quáng.

Cách tiếp cận này có thể giúp củng cố độ tin cậy của các ứng dụng AI trong các hệ sinh thái Web3. Dù là trong phân tích dữ liệu, quản trị phi tập trung hay quy trình tự động, các cơ chế xác minh có thể cung cấp thêm sự tự tin cho người dùng tương tác với các hệ thống AI.

Trong chiến dịch #Mira, quan sát cách cộng đồng phản ứng với những ý tưởng này thật sự rất thú vị. Các giai đoạn chiến dịch thường mang đến những người tham gia mới bắt đầu khám phá tầm nhìn của dự án và thảo luận về những tác động rộng lớn hơn của việc xác minh AI.

Theo nhiều cách, giai đoạn tiếp theo của sự phát triển AI có thể không chỉ tập trung vào trí thông minh mà còn cả vào độ tin cậy. Các hệ thống có khả năng tạo ra những hiểu biết mạnh mẽ cũng phải cung cấp cách để những hiểu biết đó được xác thực.

Đây là lý do tại sao các cuộc trò chuyện xung quanh các lớp tin cậy, khung xác minh và cơ sở hạ tầng AI phi tập trung đang trở nên ngày càng quan trọng.

Theo dõi cách những ý tưởng này phát triển xung quanh @mira_network và $MIRA cung cấp một cái nhìn thú vị về cách cộng đồng Web3 đang suy nghĩ về mối quan hệ tương lai giữa AI và lòng tin.