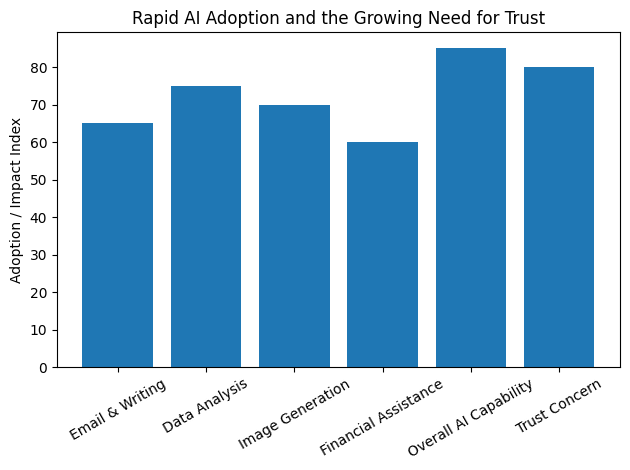

Uneori mă așez și mă gândesc cât de mult s-a schimbat lumea în doar câțiva ani. Tehnologia care odată părea science fiction este acum parte din viața de zi cu zi. Inteligența artificială este unul dintre cele mai mari exemple ale acestei transformări. Aceasta scrie e-mailuri, explică subiecte complexe, generează imagini, analizează date și chiar ajută oamenii să ia decizii financiare. Ceea ce odată necesita experți și ore de muncă poate acum să se întâmple în câteva secunde.

Privind acest progres, simt că este palpitant. În fiecare lună, sistemele de IA devin mai inteligente și mai capabile. Dar pe măsură ce observ cum această tehnologie crește, o întrebare continuă să revină în mintea mea. Dacă IA va ghida decizii importante, cum știm când spune de fapt adevărul?

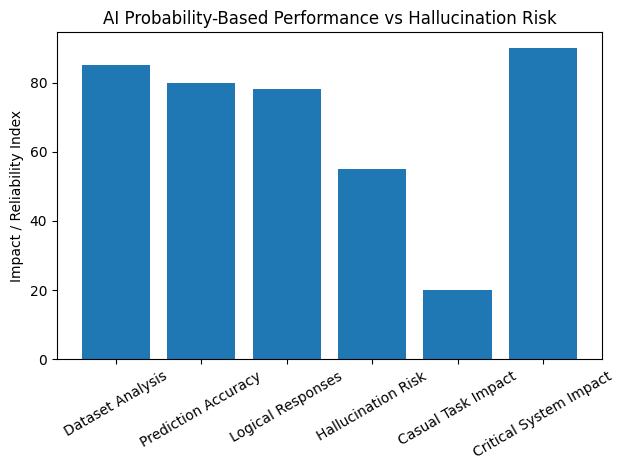

Cele mai multe modele AI de astăzi sunt construite în jurul probabilității. Ele analizează seturi mari de date și încearcă să prezică răspunsul cel mai probabil la o întrebare. Această metodă funcționează surprinzător de bine în majoritatea timpului. Dar nu este perfectă. Sistemele AI uneori produc răspunsuri care sună încrezător și logic, dar sunt complet greșite. Aceste greșeli sunt adesea numite halucinații. Sistemul ar putea inventa informații, înțelege greșit sursele sau combina date în moduri care creează ceva credibil, dar nu factual.

Pentru sarcini simple de zi cu zi, această problemă poate să nu fie foarte serioasă. Dacă un asistent AI face o mică greșeală în timp ce rezumă un document sau răspunde la o întrebare casuală, impactul este de obicei mic. Dar situația devine foarte diferită când AI începe să influențeze sisteme în care acuratețea contează cu adevărat.

Imaginează-ți inteligența artificială analizând piețele financiare și ajutând la ghidarea strategiilor de investiții. Gândește-te la sistemele de tranzacționare automate care se bazează pe predicțiile AI pentru a lua decizii în timp real. Consideră cercetarea științifică în care modelele AI interpretează date complexe, sau rețelele blockchain descentralizate în care agenții automați ajută la gestionarea economiilor digitale. În aceste medii, chiar și o mică eroare ar putea crea consecințe semnificative.

O singură presupunere greșită într-o strategie de tranzacționare automată ar putea duce la pierderi financiare mari. O interpretare defectuoasă a AI în cercetarea științifică ar putea încetini descoperirea sau crea concluzii înșelătoare. În sistemele descentralizate, informațiile nesigure ar putea deteriora încrederea și afecta întreaga comunitate. Pe măsură ce inteligența artificială se adâncește în aceste medii cu impact ridicat, fiabilitatea devine una dintre cele mai importante provocări în tehnologia modernă.

Aici este locul în care Mira Network introduce o soluție interesantă.

În loc să se concentreze doar pe construirea de modele AI mai rapide sau mai puternice, Mira Network se concentrează pe verificare. Proiectul abordează inteligența artificială dintr-un unghi diferit. În loc să întrebe cât de inteligent poate deveni AI, Mira se concentrează pe cum informațiile sale pot fi validate și de încredere.

Ideea din spatele Mira Network este surprinzător de simplă, dar puternică. Când un AI generează un răspuns complex, sistemul nu tratează acel răspuns ca pe o singură bucată de adevăr. În schimb, rezultatul este împărțit în afirmații mai mici. Fiecare dintre aceste afirmații poate fi apoi evaluată independent.

Aceste afirmații sunt distribuite printr-o rețea de validatori independenți. Fiecare validator examinează afirmația și verifică dacă informațiile sunt corecte. Deoarece mulți participanți sunt implicați, rezultatul final este format prin consens descentralizat, mai degrabă decât bazându-se pe un singur model sau organizație.

Acest proces ajută la reducerea riscului de prejudecăți și îmbunătățește fiabilitatea. În loc să aibă încredere într-un singur sistem AI, rețeaua verifică informațiile în mod colectiv. Tehnologia blockchain ajută la susținerea acestui sistem prin înregistrarea rezultatelor verificării în jurnale transparente și auditable. Oricine poate revizui modul în care informațiile au fost validate și poate vedea procesul din spatele rezultatului final.

O altă parte importantă a designului este structura de stimulente. Participanții care oferă verificări corecte sunt recompensați, în timp ce comportamentul necinstit poate duce la penalizări. Acest lucru încurajează participarea onestă și ajută la menținerea integrității rețelei.

Ce face acest concept deosebit de interesant este rolul său potențial în viitorul sistemelor autonome. În anii următori, agenții AI ar putea interacționa direct cu platformele de finanțe descentralizate, contracte inteligente și economii digitale. Acești agenți ar putea analiza piețele, executa strategii și gestiona resursele automat. Într-o astfel de lume, informațiile verificate devin esențiale.

Mira Network își propune să acționeze ca un strat de fiabilitate pentru aceste sisteme inteligente. Prin verificarea rezultatelor generate de AI înainte ca acestea să influențeze deciziile importante, rețeaua poate reduce riscurile și crește încrederea în procesele automate.

Pe măsură ce inteligența artificială continuă să se extindă în noi domenii ale tehnologiei, încrederea va deveni la fel de importantă ca și capacitatea. Algoritmii puternici singuri nu vor fi suficienți. Sistemele care vor avea succes vor fi cele care pot dovedi că informațiile lor sunt fiabile.

Mira Network reprezintă un prim pas către acel viitor. Arată că următoarea evoluție a AI s-ar putea să nu fie doar despre crearea de mașini mai inteligente, ci și despre construirea de sisteme care asigură că inteligența poate fi de încredere.