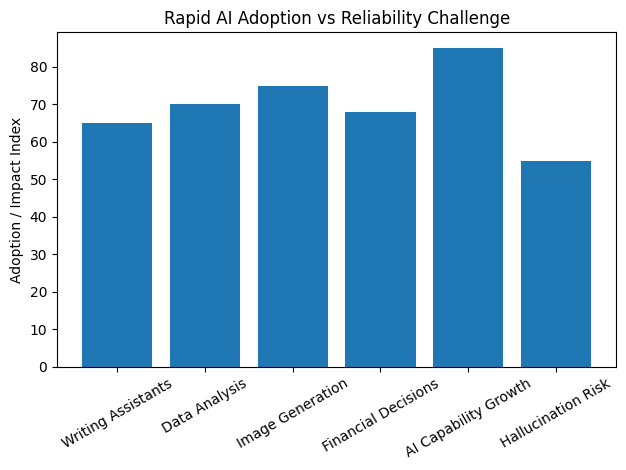

Mă gândesc adesea la cât de repede se schimbă tehnologia în jurul nostru. Inteligența artificială, care odată părea ceva îndepărtat și experimental, a devenit rapid parte din rutinele noastre zilnice. O vedem în asistenți de scriere, instrumente de analiză a datelor, platforme de generare a imaginilor și chiar în sistemele de decizie financiară. Ceva ce odată necesita echipe de experți poate acum fi realizat de un model IA în câteva secunde.

Această progres rapid este captivant, dar ridică de asemenea o întrebare importantă. Pe măsură ce ne bazăm mai mult pe IA, cum știm că informațiile pe care le oferă sunt de fapt corecte?

Multe sisteme AI de astăzi funcționează analizând seturi mari de date și prezicând cel mai probabil răspuns la o întrebare. Aceste sisteme sunt incredibil de puternice, dar nu sunt perfecte. Uneori, ele generează răspunsuri care sună încrezătoare și logice, dar conțin erori sau informații complet fabricate. Această problemă, adesea numită halucinație AI, subliniază una dintre cele mai mari slăbiciuni ale inteligenței artificiale moderne.

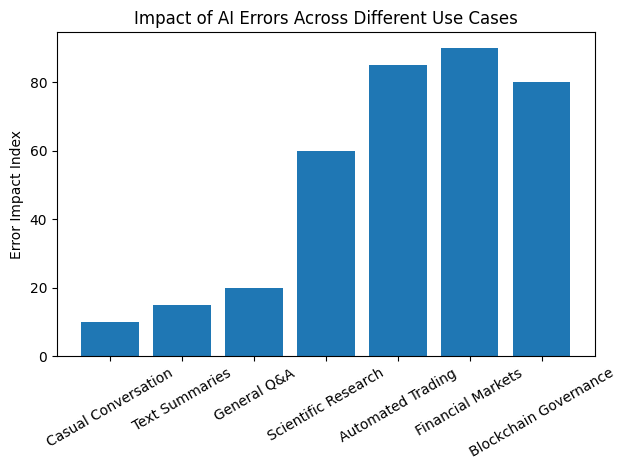

Pentru sarcini simple sau conversații ocazionale, aceste greșeli ar putea să nu cauzeze probleme majore. Dacă un AI face o mică eroare în timp ce rezumă un text sau răspunde la o întrebare generală, consecințele sunt de obicei minime. Cu toate acestea, situația devine mult mai serioasă atunci când AI începe să influențeze decizii importante.

Imaginează-ți că AI este utilizat pe piețele financiare pentru a analiza tendințele și a ghida investițiile. Ia în considerare sistemele de tranzacționare automatizate care se bazează pe predicțiile AI pentru a executa tranzacții. Gândește-te la cercetarea științifică în care modelele AI ajută la interpretarea datelor sau la sistemele de guvernanță blockchain în care agenții automatizați ajută la gestionarea economiilor digitale. În aceste situații, chiar și o mică greșeală poate avea consecințe majore.

O presupunere incorectă într-un algoritm de tranzacționare ar putea declanșa pierderi financiare mari. O interpretare greșită a datelor de cercetare ar putea încetini progresul științific. În rețelele descentralizate, informațiile nesigure ar putea deteriora încrederea și perturba întregi ecosisteme. Pe măsură ce inteligența artificială intră în aceste medii cu impact înalt, fiabilitatea devine mai importantă ca niciodată.

Aici este locul unde Mira Network introduce o idee convingătoare.

În loc să se concentreze doar pe construirea de modele AI mai mari și mai puternice, Mira Network se concentrează pe asigurarea că rezultatele AI pot fi verificate. Proiectul abordează inteligența artificială dintr-o perspectivă diferită. În loc să întrebe cât de rapidă sau complexă poate deveni AI, Mira întreabă cât de de încredere poate fi informația sa.

Conceptul din spatele Mira Network este centrat pe verificare. Atunci când un sistem AI generează informații, Mira nu acceptă pur și simplu rezultatul ca o singură bucată de adevăr. În schimb, sistemul descompune acea informație în afirmații mai mici. Fiecare afirmație poate fi apoi verificată și validată independent.

Aceste afirmații sunt distribuite pe o rețea de validatori independenți. Fiecare participant revizuiește informația și evaluează acuratețea acesteia. Deoarece mai mulți validatori participă la proces, rezultatul final este determinat prin consens descentralizat, mai degrabă decât prin încrederea într-o singură autoritate.

Această abordare reduce riscul de prejudecăți sau erori provenind dintr-un singur model sau dintr-o singură organizație. De asemenea, creează un sistem în care informațiile sunt examinate și verificate continuu de rețea însăși.

Tehnologia blockchain joacă un rol important în sprijinirea acestui proces. Rezultatele verificării pot fi înregistrate în jurnale transparente și audibile, permițând dezvoltatorilor și utilizatorilor să urmărească modul în care informația a fost validată. Această transparență ajută la construirea încrederii în sistemele care depind de date fiabile.

Un alt element cheie este mecanismul de stimulente. Participanții care contribuie la verificarea precisă sunt recompensați, în timp ce acțiunile nesincere sau neglijente pot duce la penalizări. Acest sistem încurajează participarea onestă și întărește integritatea rețelei.

Pe măsură ce inteligența artificială continuă să se extindă în domeniul financiar, cercetare și tehnologie descentralizată, importanța informațiilor fiabile va crește doar. Sistemele care se bazează pe AI vor avea nevoie de mecanisme care să confirme dacă datele pe care le folosesc sunt precise și de încredere.

Mira Network reprezintă un pas spre acel viitor. Concentrându-se pe verificare și validare descentralizată, proiectul își propune să creeze un mediu în care informațiile generate de AI nu sunt doar puternice, ci și de încredere.

Pe termen lung, succesul inteligenței artificiale nu va depinde doar de cât de inteligente devin aceste sisteme. Va depinde de cât de mult putem avea încredere în ele. Inteligența verificată ar putea deveni fundația care permite AI-ului să alimenteze în siguranță următoarea generație de sisteme digitale.