Nu am început să acord atenție Mira pentru că am crezut că avem nevoie de un alt protocol AI.

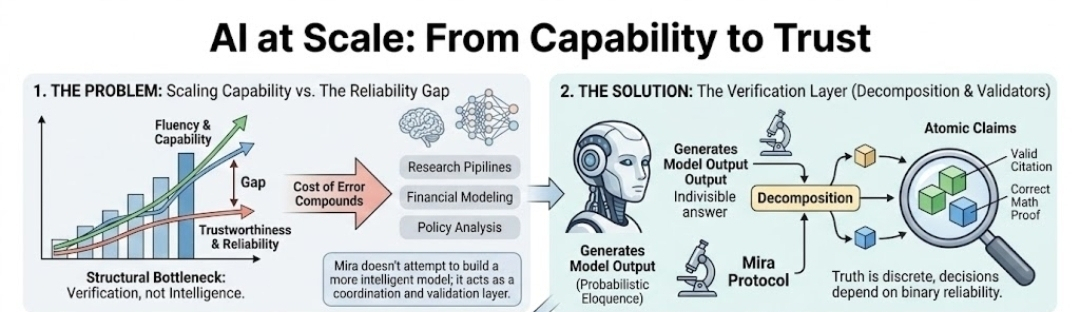

Am început să acord atenție pentru că am realizat ceva inconfortabil: AI deja pare suficient de inteligent. Ceea ce nu pare este suficient de de încredere.

Există o diferență.

Când folosesc AI astăzi, nu mă îndoiesc că poate genera conținut. Evident că poate. Întrebarea reală este dacă pot avea încredere în acel conținut fără a-l audita personal. Și acum, răspunsul sincer este nu.

Acolo se încadrează Mira Network.

Mira nu încearcă să concureze cu constructorii de modele. Nu este un alt LLM. Este un protocol de verificare descentralizat conceput să stea între output-ul AI și încredere. Acea poziționare este subtilă, dar schimbă întreaga conversație.

În loc să presupună că răspunsul unui model este o singură, indivizibilă adevăr, Mira împarte output-urile în afirmații discrete. Aceste afirmații sunt apoi distribuite pe o rețea de validatori independenți. Fiecare validator — care poate fi el însuși un sistem AI — evaluează afirmația separat. Consensul este atins prin coordonarea blockchain și stimulente economice.

Așadar, modelul de încredere se schimbă.

Nu te mai bazezi pe încrederea unui singur model. Te bazezi pe acorduri distribuite în condiții susținute de stake. Validarea este înregistrată pe blockchain. Incentivele recompensează evaluarea precisă și penalizează aprobarea neglijentă.

Adevărul devine aplicat economic, mai degrabă decât presupus reputațional.

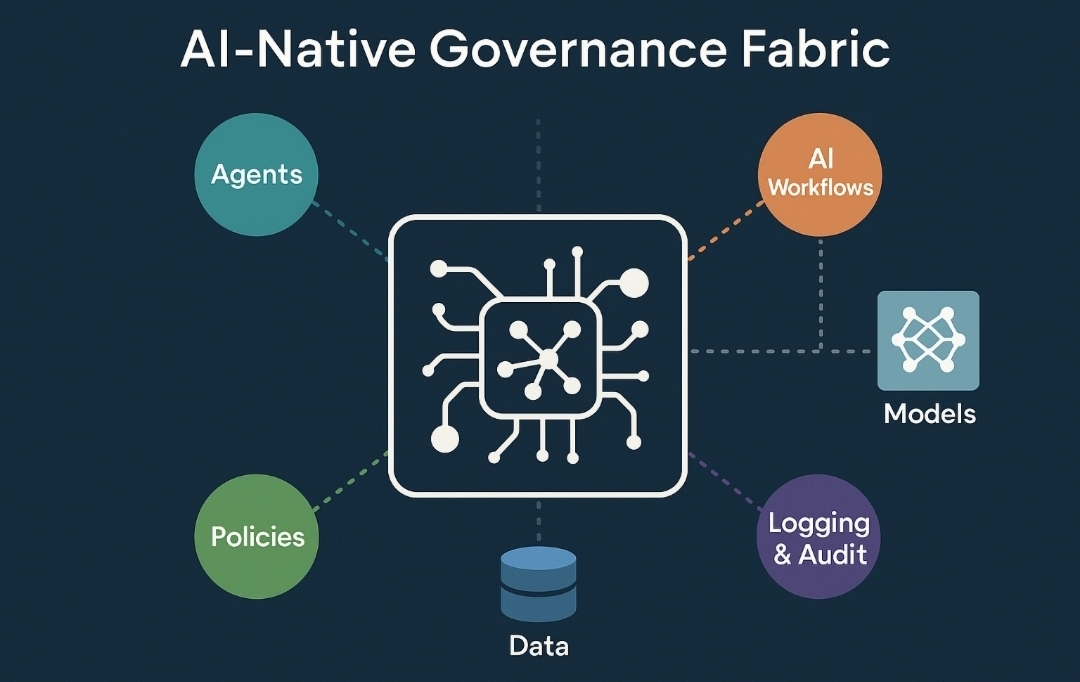

Ceea ce face ca aceasta să fie mai mult decât o teorie este direcția în care se îndreaptă AI. Vedem deja forme timpurii de agenți autonomi gestionând portofolii, interacționând cu DeFi, automatizând fluxuri de lucru și generând cercetări. De îndată ce AI trece de la sugestie la execuție, „probabil corect” nu mai este suficient.

Mira nu presupune că halucinațiile vor dispărea odată cu modelele mai mari. Acceptă că output-urile probabilistice sunt inerente arhitecturilor actuale. În loc să lupte cu asta la nivelul modelului, construiește un strat de fiabilitate în jurul său.

Asta se simte realist.

Desigur, această arhitectură introduce complexitate. Descompunerea raționamentului în afirmații verificabile nu este trivială. Verificarea adaugă latență. Diversitatea validatorilor trebuie menținută pentru a preveni biasul corelat. Riscurile de coluziune trebuie să fie atenuate cu atenție.

Dar teza de bază este greu de ignorat:

Inteligența fără verificare nu se scalează în siguranță.

Moderarea centralizată nu va fi suficientă dacă AI devine infrastructură. Reputația nu va fi suficientă odată ce sistemele operează autonom în domeniile financiar, legal și industrial.

Mira se poziționează ca stratul de încredere pentru AI — convertind output-urile probabilistice ale modelului în informații susținute de consens.

Nu este strălucitor. Nu urmărește reperele modelului. Rezolvă o slăbiciune structurală în modul în care AI este în prezent implementat.

Și dacă AI continuă să se îndrepte spre execuție autonomă, protocoalele de verificare precum Mira nu vor părea opționale.

Vor părea necesare.