Mira Network este unul dintre acele proiecte pe care am ajuns să le studiez nu din cauza hype-ului, ci dintr-o întrebare practică: cum verificăm de fapt informațiile generate de AI într-un mod care să nu depindă de încrederea într-o singură companie?

După ce am citit protocolul de design și am urmărit actualizările de la @Mira - Trust Layer of AI , a devenit clar că Mira Network se concentrează pe ceva foarte specific. Nu încearcă să construiască un alt model de limbaj mare. Construiește un strat de verificare descentralizat pentru sistemele AI.

Ideea centrală din spatele #MiraNetwork este simplă, dar importantă. Modelele AI generează rezultate care adesea sună încrezător, chiar și atunci când greșesc. Halucinații, prejudecăți subtile, citate fabricate, acestea nu sunt cazuri rare. Ele sunt slăbiciuni structurale în modul în care modelele mari prezic text.

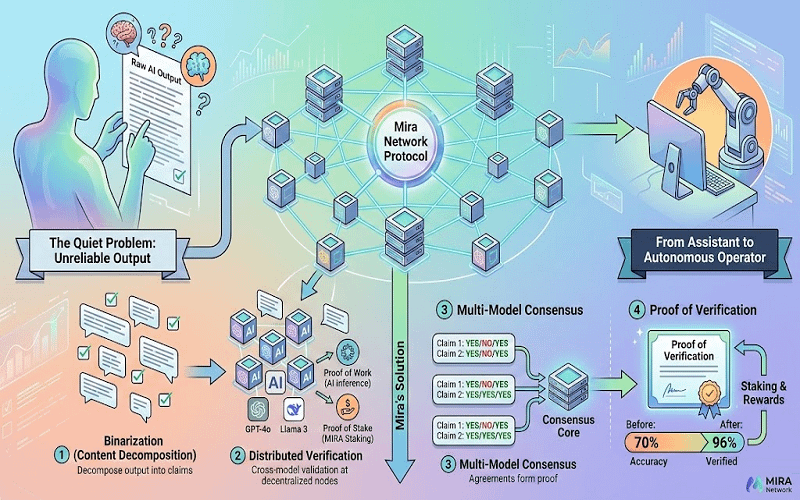

Mira abordează aceasta tratând rezultatele AI ca seturi de afirmații mai degrabă decât ca un singur bloc de text.

În loc să întrebe, „Este acest răspuns întreg corect?” protocolul descompune rezultatul în afirmații mai mici, verificabile. Fiecare afirmație poate fi evaluată apoi independent de alte modele AI care funcționează ca verificatori.

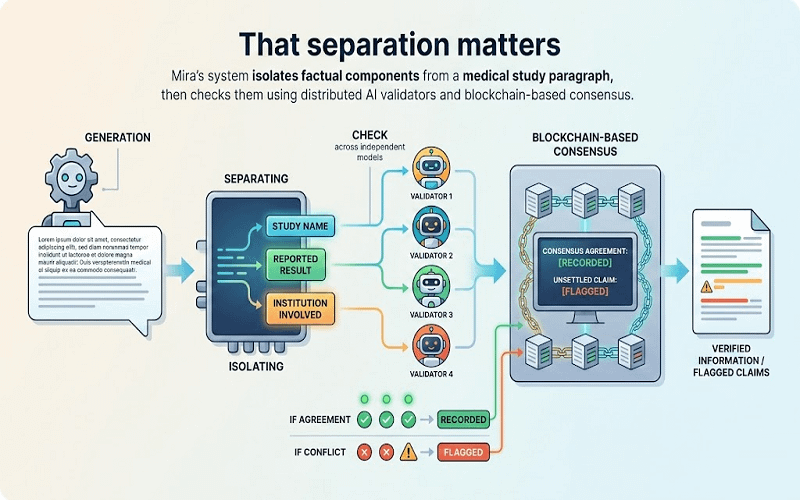

Această separare contează.

Dacă un model generează un paragraf despre un studiu medical, sistemul lui Mira izolează componentele factuale. De exemplu, numele studiului, rezultatul raportat, instituția implicată. Aceste piese sunt apoi verificate între modele independente. Dacă mai multe modele sunt de acord, acel acord este înregistrat. Dacă există conflicte, afirmația este semnalizată.

Îmi amintește de modul în care funcționează rețelele de verificare a faptelor în jurnalism. Un reporter scrie povestea, dar editorii și revizorii externi verifică faptele individuale. Diferența aici este că „editorii” sunt validatori AI distribuiți coordonați prin consens bazat pe blockchain.

Aici stratul blockchain devine relevant.

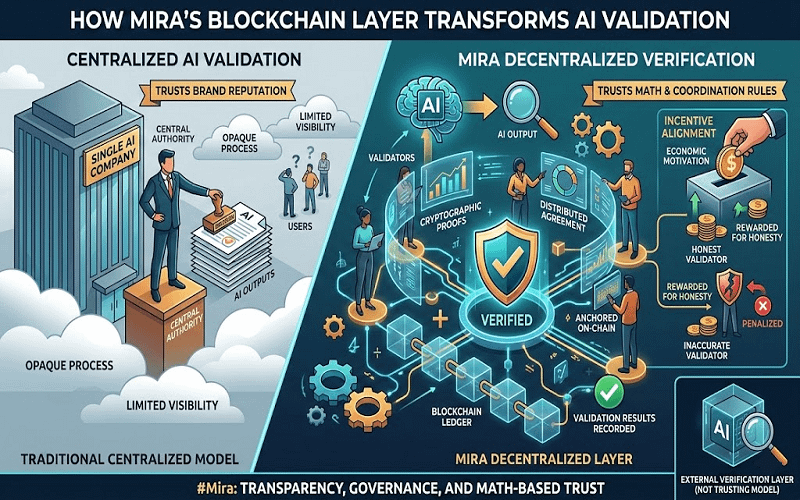

În loc să se bazeze pe o autoritate centrală pentru a declara ceva verificat, Mira folosește dovezi criptografice și mecanisme de acord distribuite pentru a înregistra rezultatele validării. Odată ce o afirmație a fost evaluată și consensul a fost atins, acel rezultat este ancorat pe lanț. Încrederea provine din matematică și reguli de coordonare, nu din reputația mărcii.

Tokenul $MIRA joacă un rol în alinierea stimulentelor în acest sistem. Validatorii sunt motivați economic să se comporte cinstit deoarece verificarea inexactă poate fi penalizată. În teorie, aceasta reduce riscul de coluziune sau validare neglijentă.

Ceea ce face aceasta diferit de validarea AI centralizată este guvernarea și transparența. Într-o configurație tipică, o singură companie decide cum sunt testate rezultatele, ce contează ca fiind precis și cum sunt gestionate corecțiile. Utilizatorii au o vizibilitate limitată asupra acelui proces.

Cu #Mira , stratul de verificare este extern modelului în sine. Nu presupune că modelul este de încredere. Presupune opusul și construiește un mecanism pentru a-l testa continuu.

Această separare se simte structural mai curată.

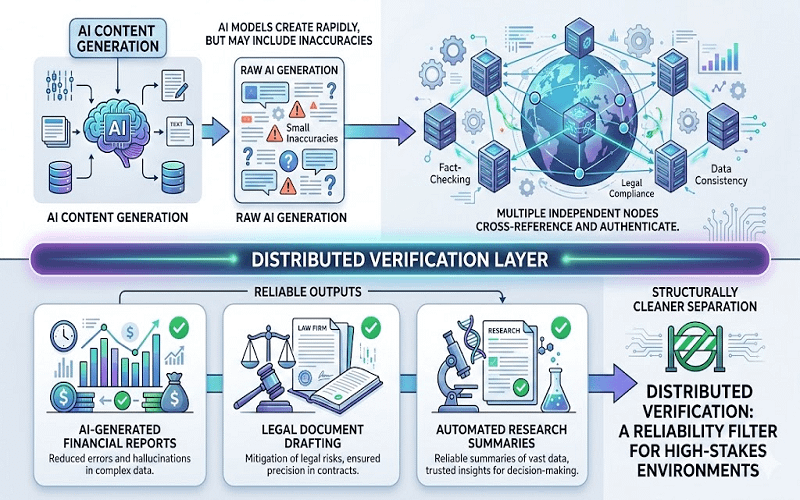

De asemenea, deschide cazuri de utilizare practice. Gândiți-vă la rapoartele financiare generate de AI, redactarea documentelor legale sau rezumatele automate ale cercetărilor. În aceste domenii, chiar și mici inexactități pot cauza probleme reale. Un strat de verificare distribuit ar putea acționa ca un filtru de fiabilitate înainte ca informațiile să fie utilizate în medii cu mize mari.

Desigur, acest design nu este lipsit de compromisuri.

Rularea mai multor modele AI pentru a verifica rezultatele crește costul computațional. Coordonarea între validatorii distribuiți introduce latență. Și infrastructura AI descentralizată devine aglomerată, cu mai multe protocoale explorând teritorii similare. Mira Network este încă la început în ceea ce privește maturitatea ecosistemului, iar adoptarea pe scară largă va depinde de cât de eficient poate scala verificarea fără a o face prohibitv de costisitoare.

Există de asemenea o întrebare mai profundă despre epistemologie. Dacă mai multe sisteme AI sunt de acord asupra a ceva incorect, consensul singur nu garantează adevărul. Designul lui Mira reduce eroarea individuală a modelului, dar nu elimină biasul sistemic între modelele antrenate pe date similare.

Totuși, consider că accentul este disciplinat.

În loc să încerce să construiască cel mai inteligent model, Mira Network construiește un strat care presupune că inteligența este imperfectă și necesită verificare. Această schimbare de perspectivă se simte practică.

Când mă uit la intersecția mai largă dintre AI și blockchain, multe proiecte urmăresc metrici de performanță. Mira pare mai preocupată de infrastructura de fiabilitate. Tratarea verificării ca o problemă de primă clasă mai degrabă decât o reflecție secundară.

Și într-o lume în care rezultatele AI influențează din ce în ce mai mult deciziile, acel strat tăcut de validare ar putea conta mai mult decât o altă îmbunătățire marginală a dimensiunii modelului.