Mira Network è uno di quei progetti che ho finito per studiare non per il clamore, ma per una domanda pratica: come possiamo effettivamente verificare le informazioni generate dall'IA in un modo che non dipenda dal fidarsi di un'unica azienda?

Dopo aver esaminato il design del protocollo e seguito gli aggiornamenti da @Mira - Trust Layer of AI , è diventato chiaro che Mira Network è concentrato su qualcosa di molto specifico. Non sta cercando di costruire un altro grande modello linguistico. Sta costruendo uno strato di verifica decentralizzato per i sistemi di intelligenza artificiale.

L'idea centrale dietro #MiraNetwork è semplice ma importante. I modelli di intelligenza artificiale generano output che spesso suonano sicuri, anche quando sono errati. Allucinazioni, bias sottili, citazioni fabricate, non sono casi rari. Sono debolezze strutturali nel modo in cui i grandi modelli prevedono il testo.

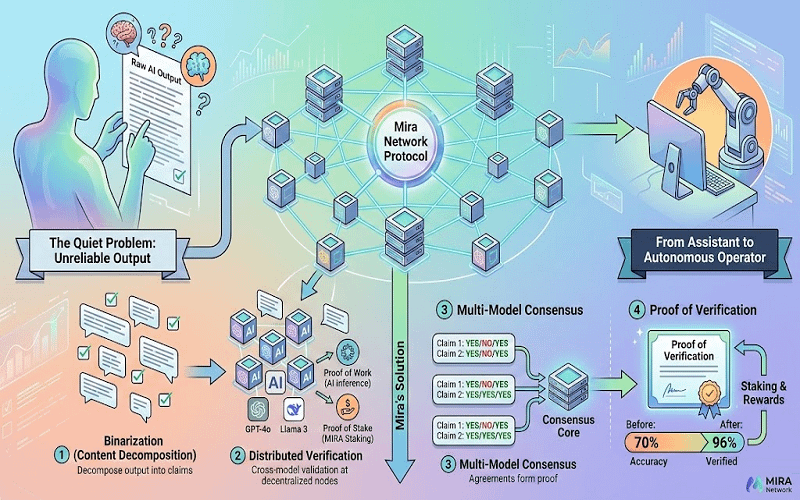

Mira affronta questo trattando le uscite AI come insiemi di affermazioni piuttosto che come un blocco unico di testo.

Invece di chiedere: “Questa risposta intera è corretta?”, il protocollo suddivide l'output in affermazioni più piccole e verificabili. Ogni affermazione può poi essere valutata indipendentemente da altri modelli AI che operano come verificatori.

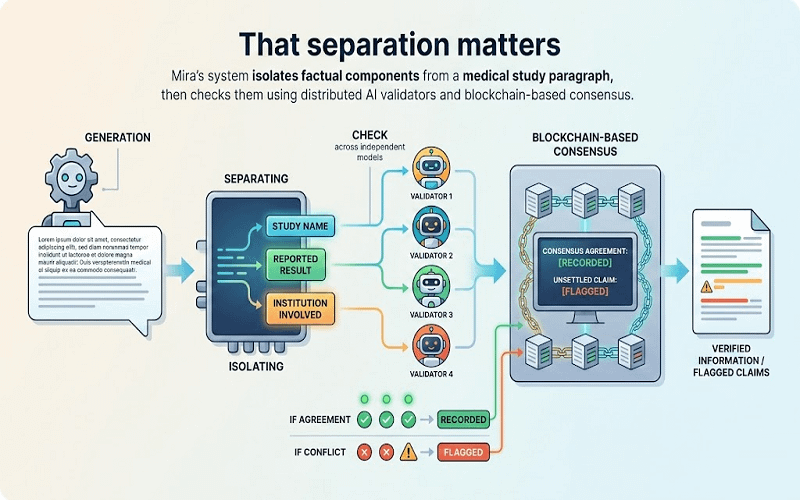

Quella separazione è importante.

Se un modello genera un paragrafo su uno studio medico, il sistema di Mira isola i componenti fattuali. Ad esempio, il nome dello studio, il risultato riportato, l'istituzione coinvolta. Questi pezzi vengono quindi controllati tra modelli indipendenti. Se più modelli concordano, quel consenso viene registrato. Se entrano in conflitto, l'affermazione viene segnalata.

Mi ricorda il modo in cui funzionano le reti di verifica dei fatti nel giornalismo. Un reporter scrive la storia, ma editor e revisori esterni verificano i fatti individuali. La differenza qui è che gli “editor” sono validatori AI distribuiti coordinati attraverso un consenso basato su blockchain.

Qui il livello blockchain diventa rilevante.

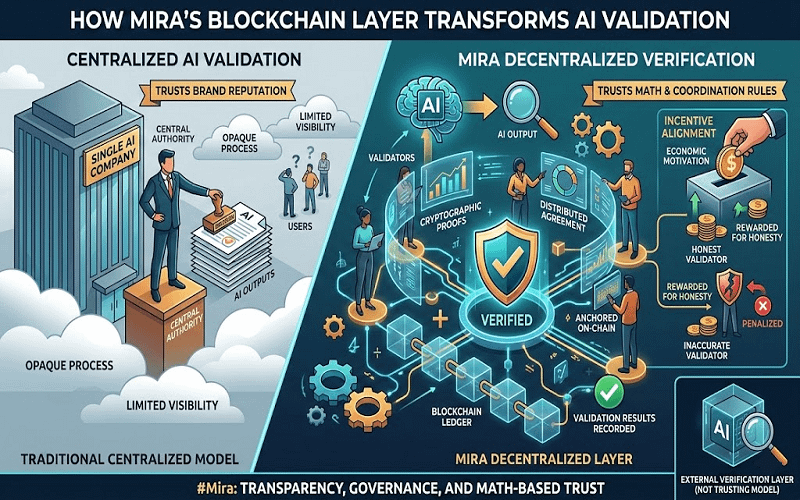

Invece di fare affidamento su un'autorità centrale per dichiarare qualcosa di verificato, Mira utilizza prove crittografiche e meccanismi di accordo distribuiti per registrare i risultati di validazione. Una volta che un'affermazione è stata valutata e si raggiunge un consenso, quel risultato è ancorato sulla catena. La fiducia deriva dalla matematica e dalle regole di coordinamento, non dalla reputazione del marchio.

Il token $MIRA svolge un ruolo nell'allineare gli incentivi all'interno di questo sistema. I validatori sono economicamente motivati a comportarsi onestamente perché la verifica inaccurata può essere penalizzata. In teoria, questo riduce il rischio di collusione o validazione negligente.

Ciò che rende questo diverso dalla validazione AI centralizzata è la governance e la trasparenza. In una configurazione tipica, una singola azienda decide come vengono testati i risultati, cosa conta come accurato e come vengono gestite le correzioni. Gli utenti hanno una visibilità limitata su quel processo.

Con #Mira la fase di verifica è esterna al modello stesso. Non presume che il modello sia affidabile. Presume il contrario e costruisce un meccanismo per testarlo continuamente.

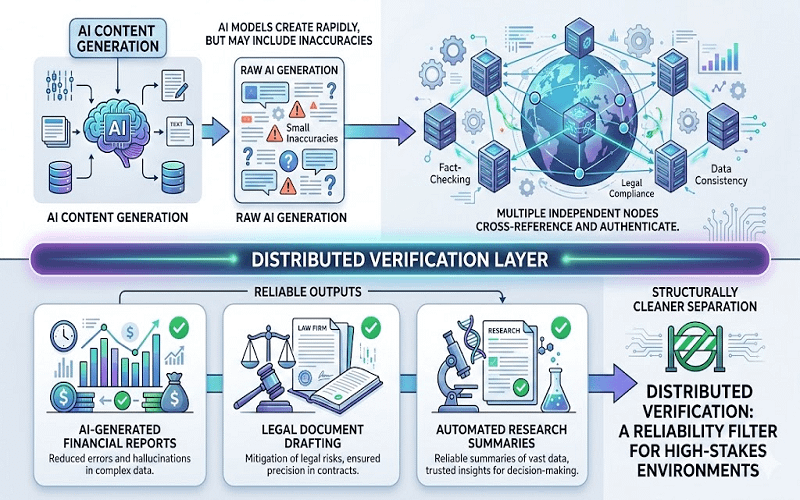

Quella separazione sembra strutturalmente più pulita.

Apre anche casi d'uso pratici. Pensa ai rapporti finanziari generati da AI, alla redazione di documenti legali o ai riassunti di ricerca automatizzati. In questi ambiti, anche piccole imprecisioni possono causare problemi reali. Un livello di verifica distribuito potrebbe fungere da filtro di affidabilità prima che le informazioni vengano utilizzate in ambienti ad alto rischio.

Certo, questo design non è privo di compromessi.

Eseguire più modelli AI per controllare le uscite aumenta il costo computazionale. Il coordinamento tra validatori distribuiti introduce latenza. E l'infrastruttura AI decentralizzata sta diventando affollata, con diversi protocolli che esplorano territori simili. Mira Network è ancora nelle fasi iniziali in termini di maturità dell'ecosistema, e l'adozione diffusa dipenderà da quanto efficientemente può scalare la verifica senza renderla proibitivamente costosa.

C'è anche una domanda più profonda riguardo all'epistemologia. Se più sistemi AI concordano su qualcosa di errato, il solo consenso non garantisce la verità. Il design di Mira riduce l'errore individuale del modello, ma non elimina il bias sistemico tra modelli addestrati su dati simili.

Tuttavia, trovo che il focus sia disciplinato.

Invece di cercare di costruire il modello più intelligente, Mira Network sta costruendo un livello che presume che l'intelligenza sia imperfetta e necessiti di verifica. Quel cambiamento di prospettiva sembra pratico.

Quando guardo all'incrocio più ampio tra AI e blockchain, molti progetti perseguono metriche di performance. Mira sembra più preoccupata per l'infrastruttura di affidabilità. Tratta la verifica come un problema di prima classe piuttosto che come un pensiero secondario.

E in un mondo in cui le uscite AI influenzano sempre più le decisioni, quel livello silenzioso di validazione potrebbe contare più di un ulteriore miglioramento marginale nella dimensione del modello.