Ditulis oleh Tim Ilmiah Qubic

Sebuah komentar tentang makalah terbaru Nick Bostrom oleh Tim Ilmiah Qubic

Mengubah Debat Superintelligence: Bedah, Bukan Roulette

Dia baru saja menerbitkan makalah kerja baru, Waktu Optimal untuk Superintelligence: Pertimbangan Sehari-hari untuk Orang yang Ada (2026), di mana dia mengalihkan pertanyaan utama. Alih-alih bertanya apakah kita harus mengembangkan superintelligence, Bostrom fokus pada kapan waktu yang optimal untuk melakukannya. Bagi siapa pun yang mengikuti persimpangan AI dan blockchain yang berkembang pesat, kerangka kerjanya membawa implikasi mendalam tentang bagaimana kita merancang infrastruktur yang akan mendukung kecerdasan umum buatan (AGI).

Membingkai Debat Superintelligence: Operasi, Bukan Roulette

Titik awal makalah Bostrom sangat elegan dan mengganggu. Dia mengubah debat yang terpolarisasi antara “AI ya vs. AI tidak” sepenuhnya. Mengembangkan superintelligence, argumennya, tidak seperti bermain roulette Rusia. Ini lebih seperti menjalani operasi berisiko untuk kondisi yang sudah mematikan.

Apa kondisi itu? Keadaan manusia saat ini. Pertimbangkan baseline: sekitar 170.000 kematian terjadi setiap hari akibat penuaan, penyakit, dan kegagalan sistemik. Populasi global yang menua menghadapi penurunan biologis yang tidak dapat dibalik. Penyakit yang tidak dapat disembuhkan, termasuk kondisi onkologis, neurodegeneratif, dan kardiovaskular, terus membebani jutaan. Kita menghadapi risiko global yang tidak tereduksi, dari ketidakstabilan iklim, hingga korupsi institusional sistemik, hingga erosi kualitas demokratis. Pandemi, perang, dan keruntuhan seluruh sistem tetap menjadi ancaman yang selalu ada.

Mengingat kenyataan ini, Bostrom berargumen bahwa membingkai pilihan sebagai “risiko nol tanpa AI” versus “risiko ekstrem dengan superintelligence” adalah sederhana. Pertanyaan yang lebih ketat adalah: Jalur mana yang menghasilkan harapan hidup yang lebih besar dan kualitas hidup yang lebih tinggi bagi orang-orang yang sudah ada?

Dengan mengaitkan analisisnya pada kondisi nyata, saat ini dalam kehidupan manusia, Bostrom menghindari abstraksi filosofis dan spekulasi teologis. Dia berbicara tentang Anda, keluarga Anda, dan orang-orang yang hidup saat ini.

Harapan Hidup, Risiko Kematian, dan Kasus untuk Kecerdasan Umum Buatan

Ketika kita muda, risiko tahunan untuk mati sangat rendah. Secara biologis, kita jauh dari kematian dalam kebanyakan kasus. Tetapi seiring bertambahnya usia, probabilitas kematian meningkat tanpa henti karena penurunan biologis.

Jika superintelligence dapat secara radikal mengurangi atau bahkan menghilangkan penuaan, seperti yang diusulkan Bostrom, risiko kematian tahunan Anda akan tetap pada tingkat orang muda yang sehat. Kematian Anda tidak akan meningkat seiring waktu. Dalam skenario itu, harapan hidup menjadi sangat panjang.

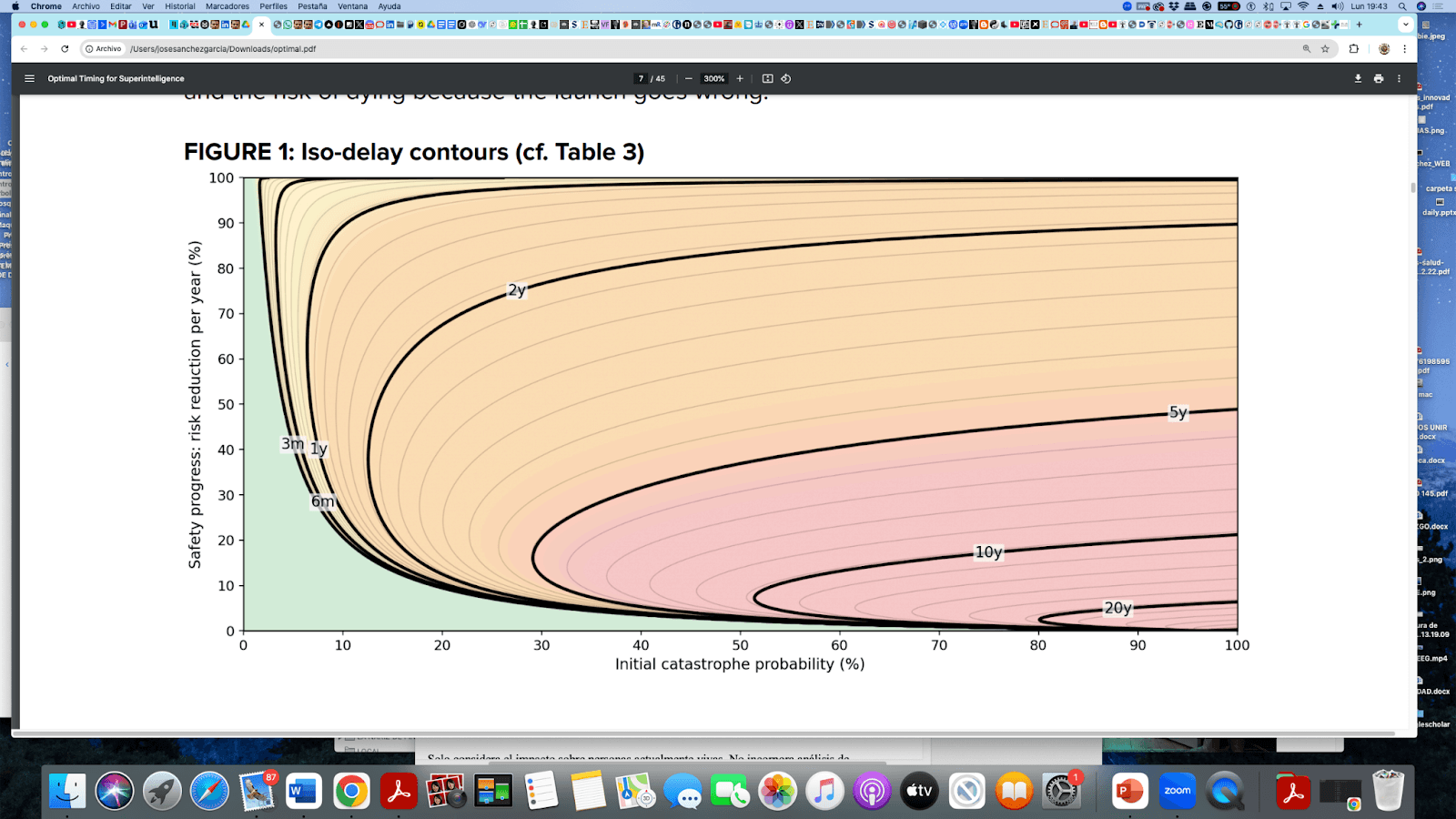

Dari sudut pandang ini, nilai yang diharapkan dari superintelligence mengkompensasi risiko tingginya. Tetapi apa yang terjadi jika kita menunda hingga teknologi menjadi “aman” sepenuhnya? Apa yang terjadi jika kita mengakumulasi probabilitas kematian dengan setiap tahun yang berlalu? Pertanyaannya menjadi: apakah lebih rasional menerima probabilitas bencana dari penempatan awal, mengingat kemajuan keselamatan AI bersifat eksponensial, atau menerima kepastian kematian yang terakumulasi dari penundaan?

Diskon Temporal dan Biaya Menunggu

Bostrom memperkenalkan konsep diskon temporal (ρ), prinsip yang telah banyak dipelajari dalam teori keputusan. Manusia secara sistematis menghargai hasil saat ini lebih tinggi daripada yang akan datang. Inilah sebabnya mengapa kita tetap di pekerjaan, hubungan, dan pola yang tidak memuaskan: usaha untuk berubah terasa besar, dan hadiahnya terasa jauh.

Tetapi di sini terjadi inversi yang menarik. Jika kehidupan setelah AGI tidak hanya lebih panjang tetapi secara dramatis lebih baik, dengan perbaikan radikal dalam kesehatan, kapasitas kognitif, dan kualitas hidup, maka diskon temporal sebenarnya menghukum penantian. Setiap tahun penundaan adalah tahun yang dihabiskan dalam kondisi yang secara kualitatif lebih buruk ketika keadaan yang jauh lebih superior dapat diakses.

Kualitas Hidup dan Aversion Risiko dalam Penempatan AGI

Model Bostrom tidak mengasumsikan umur panjang semata. Ini mencakup perbaikan substansial dalam kesejahteraan. Jika kualitas hidup menggandakan setelah transisi ke superintelligence, keseimbangan beralih secara tegas menuju penempatan lebih awal. Dia kemudian menyusun metrik aversi risiko (CRRA dan CARA), mengakui bahwa jika kita lebih sensitif terhadap kerugian ekstrem, jendela di mana “luncurkan sekarang” tetap disarankan menyempit dan penundaan optimal memanjang.

Ini bukan akselerasi yang sembrono. Ini adalah pengambilan keputusan yang terukur di bawah ketidakpastian, jenis analisis yang seharusnya memberi informasi tentang bagaimana kita mengatur jalur menuju kecerdasan umum buatan.

Penempatan Dua Fase: Cepat ke Pelabuhan, Lambat ke Dermaga

Salah satu kontribusi terkuat makalah ini adalah pembagiannya tentang transisi AGI menjadi dua fase yang berbeda:

Fase 1: Mencapai kemampuan AGI. Bergerak secepat yang bertanggung jawab menuju pembangunan sistem yang menunjukkan kecerdasan umum.

Fase 2: Jeda strategis sebelum penempatan penuh. Setelah sistem ada, perkenalkan penundaan yang terkontrol untuk mempelajarinya, mengujinya dalam kondisi nyata, dan menyelesaikan masalah keselamatan teknis yang sebelumnya hanya bersifat teoritis.

Hipotesis Bostrom adalah bahwa setelah sistem AGI benar-benar ada, “keberuntungan keselamatan” terjadi. Peneliti dapat mengamati perilaku nyata daripada berspekulasi tentangnya. Kemajuan keselamatan meningkat secara dramatis karena masalah menjadi empiris daripada abstrak. Motto yang dia ciptakan: cepat ke pelabuhan, lambat ke dermaga.

Siapa yang Paling Diuntungkan dari Transisi Lebih Awal ke Superintelligence?

Bostrom tidak memperlakukan waktu optimal sebagai universal. Orang-orang yang lebih tua, yang sakit parah, dan mereka yang hidup dalam kondisi tidak menentu memiliki sisa tahun yang diharapkan lebih sedikit. Bagi mereka, manfaat potensial dari transisi cepat ke superintelligence jauh lebih besar. Orang-orang yang lebih muda dengan dekade ke depan dapat menunggu lebih lama.

Jika Anda menerapkan logika prioritarian, memberikan bobot lebih besar kepada mereka yang berada dalam keadaan lebih buruk, garis waktu optimal bergeser ke depan. Bostrom juga secara eksplisit menolak anggapan umum bahwa setelah usia tertentu, kehidupan tambahan tidak menambah nilai. Penilaian itu, argumennya, berakar pada pengalaman kita tentang penuaan dan penurunan saat ini. Ini tidak memperhitungkan skenario pembaruan yang sebenarnya, salah satu janji sentral dari masa depan superintelligent.

Risiko Institusional: Mengapa Infrastruktur Tata Kelola AI Penting

Dalam bagian terakhir makalahnya, Bostrom memperkenalkan peringatan institusional yang kritis. Skema paling wajar, katanya, adalah satu di mana pemimpin teknologi menggunakan keuntungannya untuk keselamatan. Tetapi ia juga menandai bahaya moratorium nasional, larangan internasional, dan dinamika kompetitif yang muncul ketika banyak aktor berlomba menuju AGI di bawah tekanan geopolitik.

Analisisnya secara implisit mengasumsikan ekosistem di mana kekuatan komputasi cenderung terkonsentrasi. Dalam lingkungan seperti itu, risikonya berlipat ganda: militerisasi sumber daya komputasi, cadangan komputasi (cadangan besar siap diaktifkan di bawah tekanan kompetitif), dan insentif buruk dari sentralisasi ekstrem. Ini bukan kekhawatiran abstrak. Jalur pengembangan AI saat ini, yang didominasi oleh segelintir penyedia cloud hyperscale dan laboratorium korporat, menciptakan konsentrasi ini.

Implikasi untuk Qubic: Mengapa Infrastruktur AI Terdesentralisasi Mengurangi Risiko Eksistensial

Jika kita mengambil kerangka Bostrom dengan serius, pertanyaan dasar beralih dari “kapan meluncurkan AGI” ke jenis infrastruktur apa yang mengurangi risiko yang terkait dengan peluncuran itu. Di sinilah arsitektur Qubic menjadi relevan secara langsung dengan percakapan global tentang keselamatan superintelligence.

Masalah Sentralisasi dalam Pengembangan AI Saat Ini

Jika superintelligence dibangun di atas infrastruktur terpusat, tergantung pada pusat data yang sangat besar, jalur pelatihan yang tidak transparan, dan kontrol korporat, profil risiko meluas di luar teknis murni. Ini menjadi geopolitik. Konsentrasi komputasi membuat jenis tata kelola adaptif yang dianggap Bostrom penting selama fase pra-penempatan yang kritis jauh lebih sulit. Ini juga menciptakan jenis cadangan komputasi yang dia peringatkan: cadangan komputasi besar yang siap diaktifkan sekaligus di bawah tekanan kompetitif.

Bagaimana Arsitektur Komputasi Terdistribusi Qubic Mengatasi Risiko Ini

Qubic mengurangi bottleneck struktural itu. Arsitekturnya mendistribusikan kekuatan komputasi di seluruh jaringan global daripada mengkonsentrasikannya di satu simpul. Qubic tidak bergantung pada arsitektur tipe LLM yang dilatih secara tidak transparan di pusat data besar. Sebagai gantinya, ia memanfaatkan Bukti Kerja Berguna (uPoW), di mana penambang menyumbangkan komputasi nyata untuk pelatihan inti AI-nya, Aigarth, daripada menyelesaikan teka-teki hash sembarangan.

Pilihan desain ini memiliki implikasi langsung untuk analisis Bostrom. Infrastruktur yang kurang terpusat mengurangi probabilitas skenario penempatan mendadak dan kompetitif yang dia peringatkan. Komputasi terdistribusi berarti kekuatan tidak terletak di satu fasilitas yang dapat ditangkap secara militer, juga tidak di laboratorium korporat di bawah kendali sepihak. Ketahanan struktural itu memperluas ruang untuk Fase 2 Bostrom: jeda strategis di mana pengujian nyata, perbaikan bertahap, dan tata kelola adaptif dapat terjadi sebelum penempatan penuh.

Untuk pemahaman yang lebih dalam tentang bagaimana pendekatan Qubic terhadap AI berbeda dari model arus utama, jelajahi Neuraxon: Lompatan Besar Qubic Menuju AI yang Hidup dan Belajar dan analisis terbaru bahwa AI Statis adalah Jalan Buntu. Google Mengonfirmasi.. Pos-pos ini menggambarkan bagaimana Qubic membangun kecerdasan melalui paradigma yang pada dasarnya berbeda: satu yang dirancang untuk pembelajaran berkelanjutan, ketahanan terdistribusi, dan adaptasi dunia nyata di jaringan desentralisasi yang bisa diikuti siapa saja.

AI Terdesentralisasi dan Blockchain: Penyesuaian Struktural dengan Keamanan AGI

Dari perspektif Bostrom, potensi Qubic tidak terletak hanya pada menjadi “terdesentralisasi” sebagai latihan merek. Ini terletak pada memodifikasi variabel struktural yang menentukan waktu optimal untuk penempatan superintelligence. Dengan mendistribusikan komputasi, membangun protokol konsensus yang menyelaraskan insentif penambang dengan pelatihan AI yang nyata, dan dengan membuat seluruh proses bersifat open-source dan dapat diaudit, Qubic menciptakan jenis infrastruktur yang membuat transisi ke AGI jauh lebih aman secara struktural.

Jika Anda tertarik pada bagaimana model penambangan CPU Qubic dan jaringan komputasi terdistribusi berkembang, penjelasan Penambangan Dogecoin di Qubic menggambarkan ekspansi terbaru dari Bukti Kerja Berguna, dan Visi Qubic 2026 menjelaskan peta jalan infrastruktur yang lebih luas yang sekarang sedang berlangsung.

Masalah Terberat: Membangun AGI yang Belajar dari Dunia

Membayangkan skenario utopis dan distopis adalah berharga. Ini, pada kenyataannya, adalah jalur terbaik untuk menciptakan masa depan yang selaras dengan kebutuhan dan nilai-nilai manusia. Namun, berpaling, menunggu tanpa tujuan, atau mempercepat tanpa batas semua gagal memberikan refleksi yang diperlukan.

Mungkin tantangan terberat saat ini bukanlah menimbang risiko percepatan transisi dan memodelkannya. Untuk saat ini, tugas terberat adalah membangun kecerdasan buatan umum yang mampu belajar sendiri dari berbagai lingkungan dinamis, menciptakan representasi dunia, dan bertindak di dalamnya. Itu adalah tantangan yang tepat di mana kerangka Neuraxon Qubic dirancang untuk mengatasi, bukan dengan melatih pada dataset statis di belakang pintu tertutup, tetapi dengan berkembang di depan umum, belajar dari kompleksitas dunia nyata di jaringan desentralisasi yang bisa diikuti siapa saja.

Referensi dan Sumber

1. Bostrom, N. (2026). Waktu Optimal untuk Superintelligence: Pertimbangan Sepele untuk Orang-orang yang Ada. Makalah kerja, v1.0.

https://nickbostrom.com/optimal.pdf

2. Bostrom, N. (2014). Superintelligence: Jalur, Bahaya, Strategi. Oxford University Press.

3. Bostrom, N. (2003). Pemborosan Astronomis: Biaya Kesempatan dari Penundaan Pengembangan Teknologi. Utilitas, 15(3), 308–314.

4. Yudkowsky, E. & Soares, N. (2025). Jika Siapa Pun Membangunnya, Semua Orang Mati.

5. Hall, R. E. & Jones, C. I. (2007). Nilai Kehidupan dan Kenaikan Pengeluaran Kesehatan. Jurnal Ekonomi Kuartalan, 122(1), 39–72.

6. Tim Ilmiah Qubic. Neuraxon: Lompatan Besar Qubic Menuju AI yang Hidup dan Belajar.

https://qubic.org/blog-detail/neuraxon-qubic-s-big-leap-toward-living-learning-ai

7. Diskusi komunitas LessWrong: Waktu Optimal untuk Superintelligence

https://www.lesswrong.com/posts/2trvf5byng7caPsyx/optimal-timing-for-superintelligence-mundane-considerations