J'ai continué à creuser dans cette campagne plus longtemps que prévu, en partie parce qu'elle ne se présente pas comme une réponse terminée. Cela ressemble davantage à une tentative de contourner un problème que tout le monde accepte silencieusement : personne ne partage vraiment la confiance, et pourtant nous continuons à faire semblant que les systèmes s'aligneront magiquement.

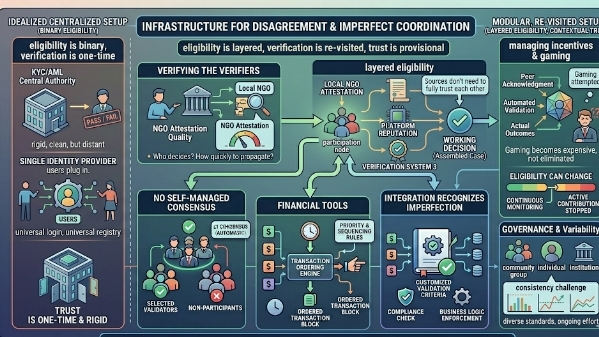

À un niveau superficiel, l'argument est simple. Construire une infrastructure numérique à laquelle les gouvernements, les organisations, voire les communautés peuvent se connecter et leur permettre de gérer la vérification, l'éligibilité et la coordination sans forcer tout à passer par un seul fournisseur d'identité. Pas de connexion universelle, pas de registre unique qui décide qui vous êtes partout.

Mais une fois que vous dépassez ce cadre, vous commencez à remarquer à quel point tout cela concerne moins la technologie et plus la gestion du désaccord.

Parce que c'est vraiment ce que c'est. Différents acteurs ne s'accordent pas sur qui est éligible, ce qui compte comme participation valide, et comment la confiance devrait être mesurée. Au lieu de résoudre ce désaccord, ce système essaie de le contenir.

L'un des premiers endroits où cela se manifeste est dans la manière dont l'éligibilité est définie. Dans une configuration centralisée typique, l'éligibilité est binaire. Vous passez KYC, répondez aux critères, ou vous ne le faites pas. C'est clair, mais rigide. Ici, l'éligibilité devient stratifiée.

J'ai vu un exemple lié à une initiative de subvention régionale. Au lieu d'un seul processus de candidature, les participants pouvaient se qualifier par plusieurs chemins. Une ONG locale pouvait attester qu'une personne a contribué à un programme communautaire. Une plateforme numérique distincte pouvait confirmer un travail antérieur ou une réputation. Un autre système pourrait vérifier que le demandeur n'a pas déjà reçu un financement similaire.

Aucune de ces sources ne se fait entièrement confiance. Et surtout, elles n'ont pas besoin de le faire.

Le système agrège ces signaux, non pas en une identité parfaite, mais en une décision fonctionnelle. C'est plus proche de l'assemblage d'un dossier que de cocher une case. Cette flexibilité est utile, surtout dans les endroits où la documentation formelle est incohérente ou incomplète. Mais cela crée également des frictions.

Parce que maintenant, vous ne vérifiez pas seulement les gens, vous vérifiez les vérificateurs.

Si une organisation locale commence à délivrer des attestations de faible qualité, le système abaisse-t-il leur crédibilité ? Qui décide cela ? Et à quelle vitesse cette décision peut-elle se propager à travers le réseau ?

Ces questions n'ont pas de réponses claires, et la campagne ne prétend pas qu'elles en aient. Au lieu de cela, elle s'appuie sur la structure. Selon la manière dont elle est déployée, différentes entités peuvent appliquer leurs propres règles au niveau de l'infrastructure.

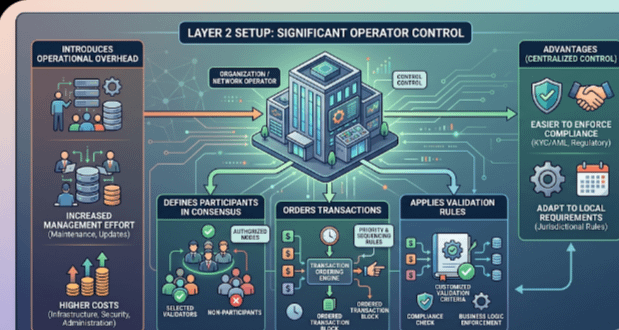

Dans une configuration de couche 2, par exemple, l'organisation qui gère le réseau a un contrôle significatif. Elle peut définir qui participe au consensus, comment les transactions sont ordonnées et quelles règles de validation s'appliquent. Ce niveau de contrôle facilite l'application de la conformité ou l'adaptation aux exigences locales. Mais cela introduit également des frais opérationnels.

Exploiter une infrastructure indépendante n'est pas trivial. Vous êtes responsable de la disponibilité, de la sécurité, de la gouvernance et des mises à jour. Si quelque chose tourne mal, que ce soit une règle défectueuse ou un validateur compromis, ce n'est pas abstrait. Cela affecte directement les utilisateurs.

Il existe un mécanisme de secours, ce qui, je pense, est l'un des choix de conception les plus pratiques. Les utilisateurs peuvent sortir vers le réseau de couche 1 sous-jacent si l'environnement de couche 2 devient peu fiable. Cela concerne moins l'élégance et plus le contrôle des dommages. Cela reconnaît l'échec comme une possibilité, pas une exception.

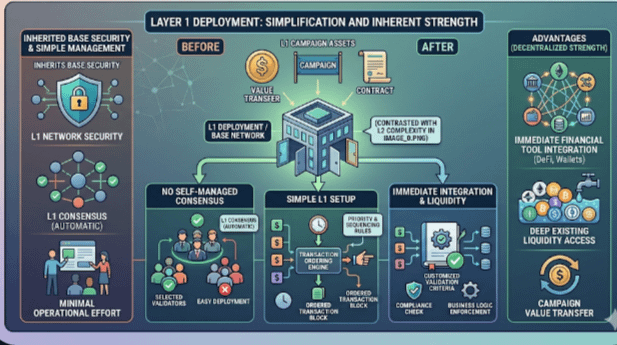

D'un autre côté, déployer directement sur la couche 1 simplifie les choses. Vous héritez de la sécurité du réseau de base et n'avez pas à gérer le consensus vous-même. L'intégration avec les outils financiers existants et la liquidité est immédiate, ce qui compte si la campagne implique un transfert de valeur réel.

Mais cette commodité vient avec des contraintes. Vous opérez au sein du système de quelqu'un d'autre. Les coûts de transaction fluctuent. Les mises à jour nécessitent une coordination soigneuse. Et votre capacité à appliquer des règles personnalisées est limitée à ce que les contrats intelligents peuvent gérer.

Encore une fois, ce n'est pas une question de mieux ou pire. C'est une question de priorités.

Ce que j'ai trouvé plus intéressant que les choix d'infrastructure était la manière dont la campagne gère la vérification continue. La plupart des systèmes traitent la vérification comme un événement unique. Vous prouvez quelque chose, cela est enregistré, et c'est la fin.

Ici, il y a une hypothèse implicite selon laquelle la vérification devrait être revisitée.

Disons que quelqu'un se qualifie pour un programme basé sur des contributions communautaires actives. Dans un système traditionnel, cela pourrait être vérifié une fois lors de la candidature. Dans ce modèle, ce statut peut être réévalué. Si les contributions cessent ou s'avèrent de faible qualité, l'éligibilité peut changer.

Cela semble juste en théorie. En pratique, cela ajoute une autre couche de complexité. Des vérifications continues ou répétées nécessitent une coordination entre plusieurs sources de données, chacune ayant ses propres cycles de mise à jour et normes.

Et puis il y a la question des incitations.

J'ai vu ce qui se passe lorsque les récompenses sont liées à des actions vérifiables. Les gens optimisent pour le métrique, pas pour l'intention. Si publier des mises à jour rapporte de la reconnaissance, vous obtenez du spam. Si la participation est récompensée, vous obtenez un engagement superficiel.

La campagne essaie de mitiger cela en diversifiant les sources de vérification. Au lieu de compter sur un seul métrique, elle recherche des signaux qui se chevauchent. Une contribution pourrait nécessiter d'être reconnue par des pairs, validée par un système automatisé et liée à des résultats réels.

Cela élève la barre, mais cela n'élimine pas les abus. Cela le rend juste plus coûteux.

Les agents automatisés jouent un rôle ici, ce que je pensais initialement simplifierait les choses. Les bots peuvent surveiller les transactions, détecter des modèles, et émettre ou révoquer des attestations en fonction de règles prédéfinies. En théorie, cela réduit la charge de travail humaine et accélère la prise de décision.

Mais l'automatisation ne supprime pas les problèmes de confiance, elle les déplace.

Maintenant, vous devez faire confiance à la logique derrière les agents. Qui a écrit les règles ? À quelle fréquence sont-elles mises à jour ? Peuvent-elles être auditées ? Et que se passe-t-il lorsqu'elles commettent des erreurs ?

Dans un scénario auquel je suis tombé, un système automatisé a signalé un ensemble de contributions comme suspectes en raison de modèles d'activité inhabituels. Il s'est avéré que c'était un effort coordonné légitime d'un petit groupe travaillant intensément pendant une courte période. Le système s'est corrigé finalement, mais pas avant d'avoir causé des retards.

Ce genre de friction est facile à ignorer dans les documents de conception. C'est beaucoup plus difficile à ignorer lorsque de vraies personnes sont affectées.

Un autre domaine où la campagne semble ancrée est la gouvernance. Au lieu de supposer une autorité unique, elle distribue la prise de décision à travers plusieurs rôles—validateurs, administrateurs, et parfois auditeurs externes. Des mécanismes de signature multiple sont utilisés pour les changements critiques, ce qui ajoute une couche de protection mais ralentit également les choses.

Rien ne bouge instantanément lorsque plusieurs parties doivent être d'accord. C'est le compromis pour réduire le contrôle unilatéral.

J'ai aussi remarqué que la participation n'est pas limitée aux institutions formelles. Des groupes communautaires, des contributeurs indépendants, voire des réseaux vaguement organisés peuvent jouer un rôle dans la vérification. Cette inclusivité est précieuse, surtout dans les régions où les systèmes centralisés n'atteignent pas tout le monde.

Mais cela introduit également de la variabilité. Tous les contributeurs n'opèrent pas avec les mêmes normes ou ressources. Maintenir la cohérence à travers un ensemble aussi diversifié de participants est un défi continu.

Ce qui empêche cela de sembler purement théorique, c'est la manière dont il gère l'imperfection. Il n'y a aucune affirmation que le système éliminera la fraude, corrigera l'identité, ou créera une coordination sans faille. Au lieu de cela, il essaie de rendre la coordination légèrement plus gérable.

Cela peut sembler peu impressionnant, mais c'est probablement plus honnête que la plupart des approches.

Si je prends du recul, ce que je vois est une infrastructure qui accepte la fragmentation comme point de départ. La confiance n'est pas unifiée—elle est négociée. L'éligibilité n'est pas fixe, elle est contextuelle. La vérification n'est pas permanente, elle est revisitée.

Cet état d'esprit s'aligne plus étroitement avec la manière dont les choses fonctionnent déjà en dehors des systèmes numériques. Différentes institutions garantissent différents aspects de votre identité. Votre éligibilité à quelque chose dépend de l'endroit où vous vous trouvez et de qui demande. Et la confiance est toujours, dans une certaine mesure, provisoire.

Que cette campagne puisse traduire cette réalité désordonnée en quelque chose d'utilisable à grande échelle reste une question ouverte.

Il y a beaucoup de points d'échec. Les frais de coordination, les normes incohérentes, le désalignement des incitations, la complexité technique—tout cela est présent. Et rien de tout cela ne disparaît simplement parce que le système est décentralisé ou modulaire.

Mais il y a aussi une certaine praticité à ne pas essayer de dépasser les limites.

Au lieu de poursuivre une solution universelle, cela construit un cadre où la confiance partielle peut s'accumuler et être réutilisée, même si ce n'est pas parfait. Cela pourrait à lui seul réduire une partie de la répétition que nous avons appris à accepter comme normale.

Je ne suis pas convaincu que cela fonctionnera sans accroc. Je suis convaincu que cela pose les bonnes questions.

Et pour l'instant, cela semble suffisant pour continuer à prêter attention.

@SignOfficial #SignDigitalSovereignInfra $SIGN