L'intelligence artificielle transforme la manière dont nous traitons l'information. Des analyses prédictives à la recherche automatisée, les systèmes d'IA aident les utilisateurs à prendre des décisions plus rapidement et à analyser des ensembles de données complexes. Cependant, à mesure que les outils d'IA sont de plus en plus utilisés, une autre question importante continue d'attirer l'attention : l'intégrité des données.

L'intégrité des données fait référence à l'exactitude et à la fiabilité des informations utilisées et générées par les systèmes numériques. Dans le contexte de l'IA, cela devient extrêmement important. Si les modèles d'IA s'appuient sur des sources de données peu fiables ou génèrent des résultats qui ne peuvent pas être vérifiés, l'utilité de ces systèmes peut rapidement devenir discutable.

Ce défi devient encore plus pertinent lorsque l'IA est intégrée dans des environnements décentralisés. Les plateformes Web3 sont conçues autour de la transparence et des interactions sans confiance, ce qui signifie que les utilisateurs comptent souvent sur des systèmes ouverts plutôt que sur des autorités centralisées. Dans de tels écosystèmes, garantir la fiabilité des informations générées par l'IA devient un facteur critique.

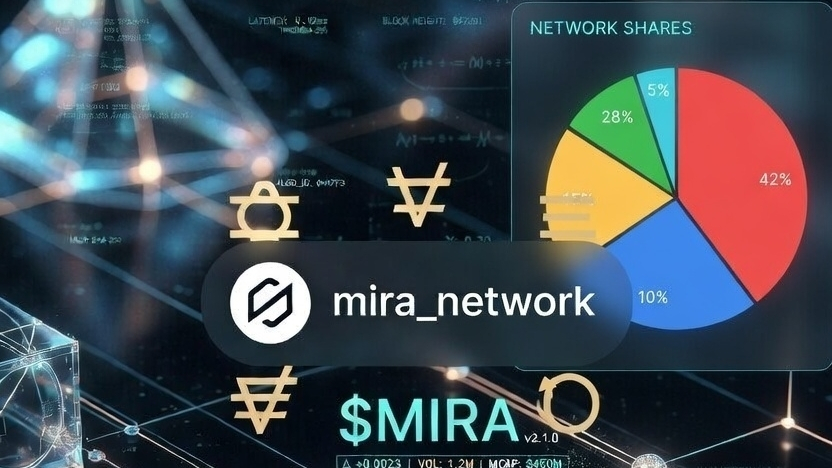

Tout en explorant différentes approches de ce défi, j'ai commencé à en apprendre davantage sur le concept derrière @mira_network. L'idée derrière $MIRA se concentre sur l'exploration d'infrastructures qui pourraient aider à renforcer la confiance dans les processus pilotés par l'IA.

Le concept est particulièrement intéressant car les systèmes d'IA sont capables de générer des résultats à une vitesse incroyable. Cependant, la vérification de ces résultats nécessite souvent des cadres et des systèmes supplémentaires qui garantissent que l'information peut être fiable. Sans mécanismes de vérification fiables, l'écart entre les aperçus générés par l'IA et les données fiables pourrait continuer à se creuser.

Dans les écosystèmes décentralisés, cet écart devient encore plus significatif. La technologie blockchain a introduit des enregistrements de transactions transparents et des mécanismes de validation décentralisés, ce qui a déjà amélioré la confiance dans les systèmes financiers et les modèles de propriété numérique. L'application de principes similaires à la vérification de l'IA pourrait aider à relever des défis liés à l'intégrité des données.

Des projets comme @mira_network explorent comment une infrastructure orientée vers la confiance pourrait soutenir les écosystèmes d'IA alors qu'ils continuent d'évoluer. Plutôt que de se concentrer uniquement sur les capacités de l'IA, le concept derrière $MIRA met également en lumière l'importance de la fiabilité et de la transparence.

À mesure que l'intelligence artificielle s'étend à des domaines tels que la finance décentralisée, l'analyse et les systèmes de gouvernance, garantir l'intégrité des données pourrait devenir une exigence fondamentale. Des informations fiables permettent aux utilisateurs de prendre de meilleures décisions, réduisent l'incertitude et renforcent la stabilité globale de l'écosystème.

Lors de la campagne #Mira, observer comment la communauté discute de ces idées offre une perspective intéressante sur l'avenir de l'infrastructure de l'IA. Les périodes de campagne introduisent souvent des projets à de nouveaux publics, encourageant des conversations sur les problèmes qu'ils visent à résoudre.

Dans le paysage technologique plus large, l'intersection de l'IA et de l'infrastructure décentralisée continue d'évoluer. Certains projets se concentrent sur la construction de modèles plus puissants, tandis que d'autres explorent des moyens de garantir que les résultats de ces modèles restent fiables.

De plusieurs manières, l'avenir des systèmes d'IA pourrait dépendre de l'équilibre entre l'innovation et la fiabilité. Des technologies puissantes nécessitent des cadres tout aussi solides qui aident à garantir que les informations qu'elles génèrent peuvent être fiables.

Observer comment les idées autour de l'infrastructure de confiance se développent au sein d'écosystèmes comme @mira_network offre un aperçu précieux de la façon dont la communauté Web3 réfléchit à la relation à long terme entre l'IA et la transparence.

Alors que ces conversations continuent, une chose devient de plus en plus claire : l'avenir de l'IA pourrait dépendre non seulement de l'intelligence des systèmes, mais aussi de la fiabilité et de la vérifiabilité de leurs résultats.