Escrito por el Equipo Científico Qubic

Un comentario sobre el último artículo de Nick Bostrom por el Equipo Científico Qubic

Reformulando el Debate sobre la Superinteligencia: Cirugía, No Ruleta

Él acaba de publicar un nuevo documento de trabajo, Tiempo Óptimo para la Superinteligencia: Consideraciones Mundanas para Personas Existentes (2026), en el que cambia la pregunta central. En lugar de preguntar si debemos desarrollar superinteligencia, Bostrom se centra en cuándo es óptimo hacerlo. Para cualquiera que siga la intersección en rápida evolución de la IA y blockchain, su marco tiene profundas implicaciones para cómo diseñamos la infraestructura que sustentará la inteligencia general artificial (AGI).

Reformular el Debate sobre la Superinteligencia: Cirugía, No Ruleta

El punto de partida del artículo de Bostrom es tanto elegante como disruptivo. Reenmarca por completo el debate polarizado de “IA sí vs. IA no”. Desarrollar superinteligencia, argumenta, no es como jugar a la ruleta rusa. Es más como someterse a una cirugía arriesgada para una condición que ya es fatal.

¿Cuál es esa condición? El estado actual de la humanidad misma. Considera la línea base: aproximadamente 170,000 muertes ocurren cada día debido al envejecimiento, enfermedades y fallos sistémicos. Una población global envejecida enfrenta un deterioro biológico irreversible. Enfermedades incurables, incluidas las oncológicas, neurodegenerativas y cardiovasculares, continúan afectando a millones. Nos enfrentamos a riesgos globales no mitigados, desde la inestabilidad climática, hasta la corrupción institucional sistémica, hasta la erosión de la calidad democrática. Pandemias, guerras y el colapso de sistemas enteros siguen siendo amenazas siempre presentes.

Dadas estas realidades, Bostrom argumenta que enmarcar la elección como “cero riesgo sin IA” frente a “riesgo extremo con una superinteligencia” es simplista. La pregunta más rigurosa es: ¿Qué trayectoria genera una mayor esperanza de vida esperada y una mayor calidad de vida para las personas que ya existen?

Al anclar su análisis en las condiciones reales y presentes de la vida humana, Bostrom elude las abstracciones filosóficas y la especulación teológica. Está hablando de ti, tu familia y las personas que están vivas ahora mismo.

Esperanza de Vida, Riesgo de Mortalidad y el Caso para la Inteligencia Artificial General

Cuando somos jóvenes, el riesgo anual de morir es extremadamente bajo. Biológicamente, estamos lejos de la muerte en la mayoría de los casos. Pero a medida que envejecemos, la probabilidad de morir aumenta implacablemente debido al deterioro biológico.

Si la superinteligencia pudiera reducir radicalmente o incluso eliminar el envejecimiento, como propone Bostrom, tu riesgo de mortalidad anual se mantendría al nivel de una persona joven y saludable. Tu mortalidad dejaría de aumentar con el tiempo. En ese escenario, la esperanza de vida se vuelve extraordinariamente larga.

Desde este punto de vista, el valor esperado de la superinteligencia compensa sus altos riesgos. Pero, ¿qué sucede si retrasamos hasta que la tecnología se vuelva perfectamente “segura”? ¿Qué pasa si acumulamos la probabilidad de morir con cada año que pasa? La pregunta se convierte en: ¿es más racional aceptar la probabilidad de catástrofe por un despliegue temprano, dado que el progreso en seguridad de IA es exponencial, o aceptar la certeza de muertes acumuladas por el retraso?

Descuento Temporal y el Costo de la Espera

Bostrom introduce el concepto de descuento temporal (ρ), un principio bien estudiado en la teoría de decisiones. Los humanos valoran sistemáticamente los resultados presentes más que los futuros. Por eso permanecemos en trabajos, relaciones y patrones insatisfactorios: el esfuerzo de cambio parece grande y la recompensa se siente lejana.

Pero aquí ocurre una inversión interesante. Si la vida después de AGI no es simplemente más larga, sino dramáticamente mejor, con mejoras radicales en salud, capacidad cognitiva y calidad de vida, entonces el descuento temporal en realidad castiga la espera. Cada año de retraso es un año pasado en una condición cualitativamente peor cuando un estado muy superior es accesible.

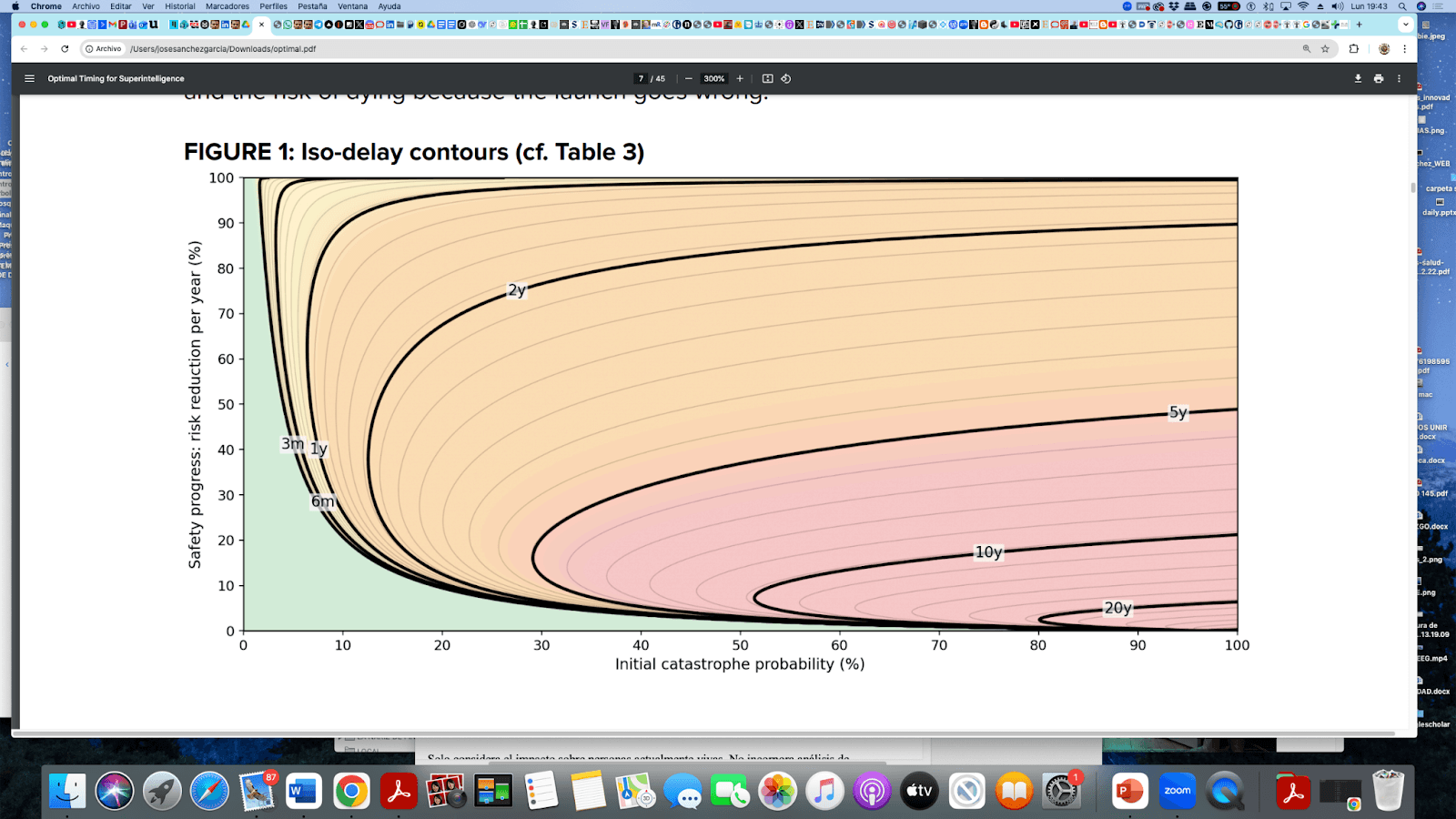

Calidad de Vida y Aversion al Riesgo en el Despliegue de AGI

El modelo de Bostrom no asume solo longevidad. Incorpora mejoras sustanciales en el bienestar. Si la calidad de vida se duplica después de la transición a la superinteligencia, el equilibrio se desplaza decisivamente hacia un despliegue más temprano. Luego añade métricas de aversión al riesgo (CRRA y CARA), reconociendo que si somos más sensibles a pérdidas extremas, la ventana donde “lanzar ahora” sigue siendo aconsejable se estrecha y los retrasos óptimos se alargan.

Esto no es aceleracionismo imprudente. Es una toma de decisiones calibrada bajo incertidumbre, el tipo de análisis que debería informar cómo gobernamos el camino hacia la inteligencia artificial general.

Despliegue en Dos Fases: Rápido hacia el Puerto, Lento hacia el Embarcadero

Una de las contribuciones más fuertes del artículo es su división de la transición de AGI en dos fases distintas:

Fase 1: Alcanzar la capacidad de AGI. Avanza tan rápido como sea responsable hacia la construcción de un sistema que demuestre inteligencia general.

Fase 2: Una pausa estratégica antes del despliegue completo. Una vez que el sistema exista, introduce un retraso controlado para estudiarlo, probarlo en condiciones reales y resolver problemas técnicos de seguridad que anteriormente eran solo teóricos.

La hipótesis de Bostrom es que una vez que un sistema AGI existe, ocurre un “beneficio de seguridad”. Los investigadores pueden observar el comportamiento real en lugar de especular sobre él. El progreso en seguridad se acelera dramáticamente porque los problemas se vuelven empíricos en lugar de abstractos. El lema que acuña: rápido hacia el puerto, lento hacia el embarcadero.

¿Quién se beneficia más de una transición más temprana a la superinteligencia?

Bostrom no trata el momento óptimo como universal. Las personas mayores, los gravemente enfermos y aquellos que viven en condiciones precarias tienen menos años esperados restantes. Para ellos, el beneficio potencial de una rápida transición a la superinteligencia es mucho mayor. Las personas más jóvenes, con décadas por delante, pueden tolerar más espera.

Si aplicas una lógica prioritaria, dando mayor peso a aquellos que están en peores condiciones, la línea temporal óptima se adelanta. Bostrom también rechaza explícitamente la suposición común de que más allá de cierta edad, la vida adicional no añade valor. Ese juicio, argumenta, está arraigado en nuestra experiencia del envejecimiento y deterioro actuales. No tiene en cuenta un escenario de rejuvenecimiento genuino, una de las promesas centrales de un futuro superinteligente.

Riesgos Institucionales: Por qué la infraestructura de gobernanza de IA es importante

En las secciones finales de su artículo, Bostrom introduce advertencias institucionales críticas. El escenario más razonable, sugiere, es uno en el que el líder tecnológico utiliza su ventaja para la seguridad. Pero también señala los peligros de moratorias nacionales, prohibiciones internacionales y las dinámicas competitivas que surgen cuando múltiples actores compiten hacia AGI bajo presión geopolítica.

Su análisis asume implícitamente un ecosistema donde el poder computacional tiende a concentrarse. En tal entorno, los riesgos se acumulan: militarización de recursos computacionales, sobrecarga de computación (reservas masivas listas para ser activadas bajo presión competitiva) y los incentivos perversos de la extrema centralización. Estas no son preocupaciones abstractas. La trayectoria actual del desarrollo de IA, dominada por un puñado de proveedores de nube hyperscale y laboratorios corporativos, crea precisamente esta concentración.

Implicaciones para Qubic: Por qué la infraestructura de IA descentralizada reduce el riesgo existencial

Si tomamos en serio el marco de Bostrom, la pregunta fundamental cambia de “cuándo lanzar AGI” a qué tipo de infraestructura reduce los riesgos asociados con ese lanzamiento. Aquí es donde la arquitectura de Qubic se vuelve directamente relevante para la conversación global sobre la seguridad de la superinteligencia.

El Problema de la Centralización en el Desarrollo Actual de IA

Si la superinteligencia se construye sobre infraestructuras centralizadas, dependientes de enormes centros de datos, pipelines de entrenamiento opacos y control corporativo, el perfil de riesgo se expande más allá de lo puramente técnico. Se vuelve geopolítico. La concentración de computación hace que el tipo de gobernanza adaptativa que Bostrom considera esencial durante la fase crítica de pre-despliegue sea mucho más difícil. También crea exactamente el tipo de sobrecarga computacional del que advierte: reservas computacionales masivas listas para ser activadas de inmediato bajo presión competitiva.

Cómo la arquitectura de computación distribuida de Qubic aborda estos riesgos

Qubic diluye ese cuello de botella estructural. Su arquitectura distribuye el poder computacional a través de una red global en lugar de concentrarlo en un solo nodo. Qubic no depende de una arquitectura tipo LLM entrenada opacamente en mega centros de datos. En cambio, aprovecha la Prueba Útil de Trabajo (uPoW), donde los mineros contribuyen con computación real al entrenamiento de su núcleo de IA, Aigarth, en lugar de resolver rompecabezas hash arbitrarios.

Esta elección de diseño tiene implicaciones directas para el análisis de Bostrom. Una infraestructura menos centralizada reduce la probabilidad de los escenarios de despliegue abrupto y competitivo contra los que advierte. La computación distribuida significa que el poder no se encuentra en una sola instalación que puede ser capturada militarmente, ni en un laboratorio corporativo bajo control unilateral. Esa resiliencia estructural expande el espacio para la Fase 2 de Bostrom: la pausa estratégica donde las pruebas reales, la mejora incremental y la gobernanza adaptativa pueden ocurrir antes del despliegue completo.

Para una comprensión más profunda de cómo el enfoque de Qubic sobre IA difiere de los modelos convencionales, explora Neuraxon: El Gran Salto de Qubic hacia la IA viviente y aprendiendo y el análisis reciente de Que la IA estática es un callejón sin salida. Google confirma.. Estas publicaciones ilustran cómo Qubic está construyendo inteligencia a través de un paradigma fundamentalmente diferente: uno diseñado para el aprendizaje continuo, la resiliencia distribuida y la adaptación al mundo real en una red descentralizada.

IA Descentralizada y Blockchain: Alineación Estructural con la Seguridad de AGI

Desde la perspectiva de Bostrom, el potencial de Qubic no radica simplemente en ser “descentralizado” como ejercicio de marca. Radica en modificar las variables estructurales que determinan el momento óptimo para el despliegue de superinteligencia. Al distribuir la computación, al construir protocolos de consenso que alineen los incentivos de los mineros con el verdadero entrenamiento de IA, y al hacer que todo el proceso sea de código abierto y auditable, Qubic crea el tipo de infraestructura que hace que la transición a AGI sea estructuralmente más segura.

Si te interesa cómo el modelo de minería CPU de Qubic y la red de computación distribuida están evolucionando, la inmersión en la minería de Dogecoin en Qubic explica la última expansión de Prueba Útil de Trabajo, y la Visión 2026 de Qubic detalla la hoja de ruta de infraestructura más amplia que ahora está en marcha.

El Problema Más Difícil: Construir AGI que Aprende del Mundo

Imaginar escenarios utópicos y distópicos es valioso. De hecho, es el mejor camino para crear futuros alineados con las necesidades y valores humanos. Pero desviar la mirada, esperar sin rumbo o acelerar sin restricción no logran proporcionar las reflexiones necesarias.

Quizás el desafío más difícil en este momento no es tanto sopesar el riesgo de acelerar la transición y modelarlo. Por ahora, la tarea más difícil es construir una inteligencia artificial general capaz de aprender por sí misma de diferentes entornos dinámicos, crear representaciones del mundo y actuar dentro de él. Ese es precisamente el desafío que el marco Neuraxon de Qubic está diseñado para abordar, no entrenando en conjuntos de datos estáticos detrás de puertas cerradas, sino evolucionando al aire libre, aprendiendo de la complejidad del mundo real en una red descentralizada en la que cualquiera puede participar.

Referencias y Fuentes

1. Bostrom, N. (2026). Momento Óptimo para la Superinteligencia: Consideraciones Mundanas para Personas Existentes. Documento de trabajo, v1.0.

https://nickbostrom.com/optimal.pdf

2. Bostrom, N. (2014). Superinteligencia: Caminos, Peligros, Estrategias. Oxford University Press.

3. Bostrom, N. (2003). Desperdicio Astronómico: El Costo de Oportunidad del Desarrollo Tecnológico Retrasado. Utilitas, 15(3), 308–314.

4. Yudkowsky, E. & Soares, N. (2025). Si alguien lo construye, todos mueren.

5. Hall, R. E. & Jones, C. I. (2007). El Valor de la Vida y el Aumento del Gasto en Salud. Quarterly Journal of Economics, 122(1), 39–72.

6. Equipo Científico de Qubic. Neuraxon: El Gran Salto de Qubic hacia la IA viviente y aprendiendo.

https://qubic.org/blog-detail/neuraxon-qubic-s-big-leap-toward-living-learning-ai

7. Discusión de la comunidad LessWrong: Momento Óptimo para la Superinteligencia

https://www.lesswrong.com/posts/2trvf5byng7caPsyx/optimal-timing-for-superintelligence-mundane-considerations